冲上热搜!DeepSeek又崩了:一月宕机三次

今日(5月24日),DeepSeek再次出现大规模服务故障,“DeepSeek崩了”话题迅速冲上微博热搜。 有大量用户反馈,使用时遭遇“服务器繁忙”提示,平台服务波动频繁,正常使用受到严重影响。 据悉,这已是本月以来DeepSeek第三次发生大范围宕机,服务稳定性问题愈发突出。 回顾近期故障,DeepSeek的运行状态持续不稳。 5月21日下午,其网页端与App出现大规模异常,深度思考等高负载功能

关于「MoE架构」的技术文章、设计资料与工程师讨论,持续更新。

今日(5月24日),DeepSeek再次出现大规模服务故障,“DeepSeek崩了”话题迅速冲上微博热搜。 有大量用户反馈,使用时遭遇“服务器繁忙”提示,平台服务波动频繁,正常使用受到严重影响。 据悉,这已是本月以来DeepSeek第三次发生大范围宕机,服务稳定性问题愈发突出。 回顾近期故障,DeepSeek的运行状态持续不稳。 5月21日下午,其网页端与App出现大规模异常,深度思考等高负载功能

4月28日凌晨,小米技术官方宣布旗舰大模型MiMo-V2.5-Pro及全模态模型MiMo-V2.5正式全球开源。 该系列模型权重已全量开放于Hugging Face等平台,采用宽松的MIT协议,允许全球开发者自由商用、微调及二次训练,无需额外授权。与此同时,小米推出MiMo Orbit计划,宣布于30天内面向全球开发者发放总计100万亿免费Token权益,并与OpenCode、Hermes Age

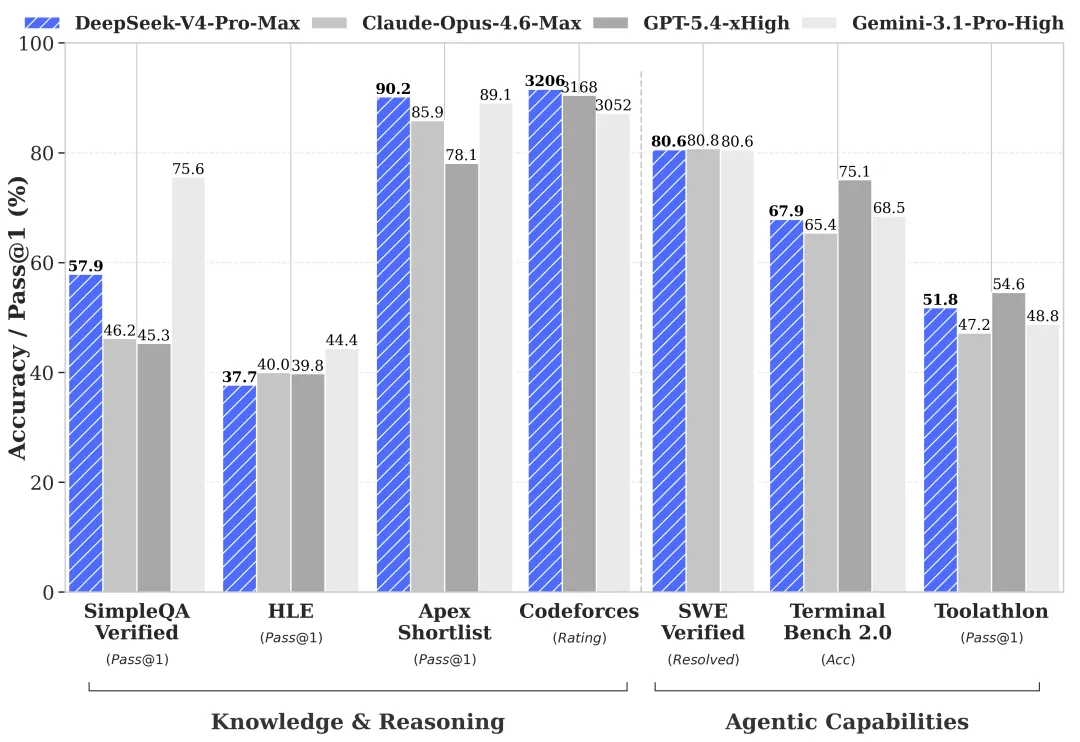

4月24日,中国人工智能公司DeepSeek正式发布并开源全新系列模型DeepSeek-V4预览版。 该系列包含Pro与Flash两个版本,均支持百万字(1M)超长上下文。官方表示,V4在Agent能力、世界知识和推理性能三大维度上达到国内与开源领域领先水平,其中Pro版本性能可比肩世界顶级闭源模型。 双版本矩阵:旗舰对标顶尖,Flash普惠经济 DeepSeek-V4采用MoE(混合专家)架构