前不久,安谋科技正式推出新一代NPU IP——“周易”X3,该产品采用专为大模型而生的最新DSP+DSA架构,兼顾CNN与Transformer,协同完善易用的“周易”NPU Compass AI软件平台,致力于为基础设施、智能汽车、移动终端、智能物联网四大领域提供AI计算核芯,打造端侧AI计算效率新标杆,加快边缘及端侧AI规模化部署。安谋科技为“周易” NPU 打造的 Compass AI 软件平台,通过“软硬协同优化”与“核心组件开源”的双重策略,打破了传统芯片 IP 工具链的封闭性,成为连接硬件能力与开发者需求的关键桥梁,也为“All in AI”战略提供了生态支撑。

传统端侧 AI 开发面临的一大痛点,是“硬件能力无法高效转化为应用价值”。即使硬件 IP 性能强大,若软件工具链易用性差、兼容性低,开发者仍需花费大量时间进行适配。某 AI 手机厂商曾反馈,过去适配一款 NPU,仅模型量化与算子调试就需 3 个月,且难以满足个性化需求。Compass AI 平台的出现,正是为了解决这一“最后一公里”问题。

在“软硬协同”层面,Compass AI 平台与“周易” X3 NPU 形成了深度联动。针对 X3 的 DSP+DSA 混合架构,平台优化了算子调度策略——AIFF 引擎(DSA)处理矩阵乘法等高频任务时,平台自动分配专用指令;TEC 处理器(DSP)承接激活函数等灵活任务时,平台调用 1200 条 AI 专用向量指令,确保算力利用率最大化。在 Llama2 7B 模型测试中,这种协同使 Prefill 算力利用率达 72%,远超行业平均的 50%。

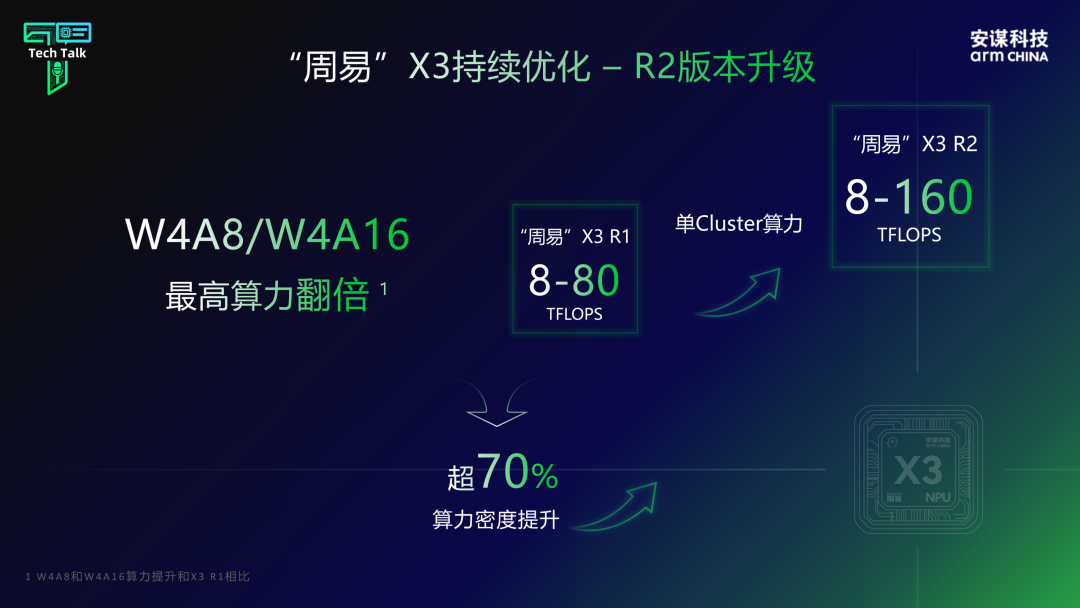

同时,平台针对 X3 的混合精度设计做了专项优化。支持 GPTQ、W4A8/W4A16 等多种量化方式,开发者无需手动调整精度参数,平台可根据模型类型(如 LLM、VLM、CNN)自动选择最优精度方案。例如,运行 Stable Diffusion 文生图模型时,平台自动采用 W4A16 精度,在保证图像质量的同时,将带宽消耗降低 75%;运行 ResNet 图像识别模型时,则切换至 INT8 精度,实现能效最大化。这种智能化的精度适配,大幅降低了开发门槛。

更关键的是,Compass AI 平台采取了“开放生态”的策略,打破了传统工具链的“黑盒”模式。平台已将 Parser(模型解析器)、Optimizer(优化器)、Linux Driver(驱动)及内部 IR(中间表示)格式等核心组件开源,开发者可通过白盒调试查看模型转化的每一步细节。例如,当开发者部署自定义的医疗影像模型时,可清晰看到 Parser 如何将 PyTorch 模型转为 IR 格式,Optimizer 如何进行算子融合与内存优化,从而快速定位问题。某医疗设备厂商反馈,采用开源组件后,模型适配问题的排查时间从 7 天缩短至 4 小时,开发效率提升 40 倍。

为满足开发者的个性化需求,平台还支持 DSL(领域特定语言)自定义算子。开发者无需了解底层硬件细节,只需通过简洁的语法描述算子逻辑(如自定义的注意力机制、病灶检测算法),DSL 编译器会自动将其转化为硬件可执行的指令。这一功能,既保护了开发者的核心算法隐私,又能让其充分利用“周易” X3 的硬件能力。例如,某智能汽车厂商通过 DSL 开发了针对自动驾驶场景的特征提取算子,性能比通用算子提升 30%,且无需向第三方暴露算法细节。

在模型适配效率上,Compass AI 平台的“AIPULLM 大模型运行工具链”实现了 Hugging Face 模型的“一键部署”。Hugging Face 作为全球最大的开源模型库,拥有数万款大模型,但传统部署流程需经过格式转换、量化优化、算子适配等多步操作,耗时 1-2 周。而 AIPULLM 工具链通过自动化脚本,可直接从 Hugging Face 下载模型,15 分钟内完成部署。在 ICCAD 展会 Demo 区,基于这一工具链的 AI 拍照亭,仅需 3 条命令就实现了 DeepSeek 模型的端侧文生文交互,响应延迟低于 300 毫秒,让观众直观感受到开发效率的提升。

对于安谋科技“AI Arm CHINA”战略而言,Compass AI 平台的价值不仅在于“降低开发门槛”,更在于“激活产业创新”。通过开源核心组件与支持自定义开发,安谋科技将硬件能力开放给千行百业的开发者,让每个场景的需求都能转化为具体的应用创新。正如安谋科技 NPU 产品线负责人舒浩博士所言:“Compass AI 平台不是一个简单的工具集合,而是‘AI Arm CHINA’战略的生态中枢。它让无形的 IP 算力,转化为触手可及的 AI 体验,这才是端侧 AI 规模化落地的关键。”

评论区

登录后即可参与讨论

立即登录