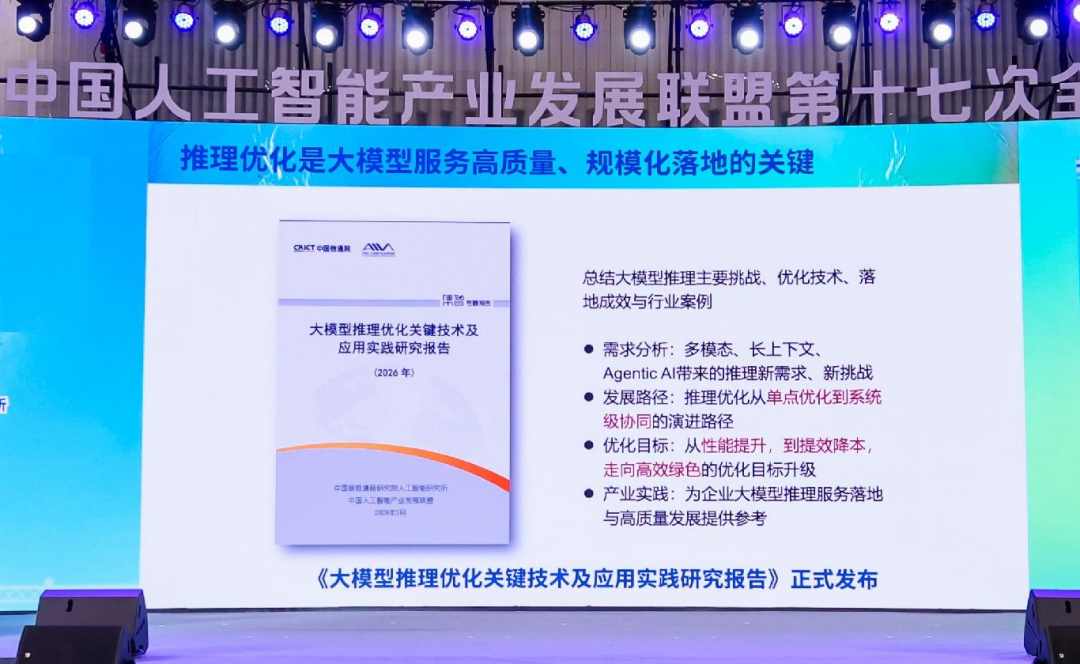

近日,在中国人工智能产业发展联盟(AIIA)第十七次全体会议上,中国人工智能产业发展联盟、中国信息通信研究院联合华为及工信部人工智能关键技术和应用评测实验室等50余家企事业单位,共同发布《大模型推理优化关键技术及应用实践研究报告》。该报告总结了大模型推理的主要挑战、优化技术、落地成效与最佳实践,旨在为企业构建高质量大模型推理基础设施提供权威的标准建设指导。

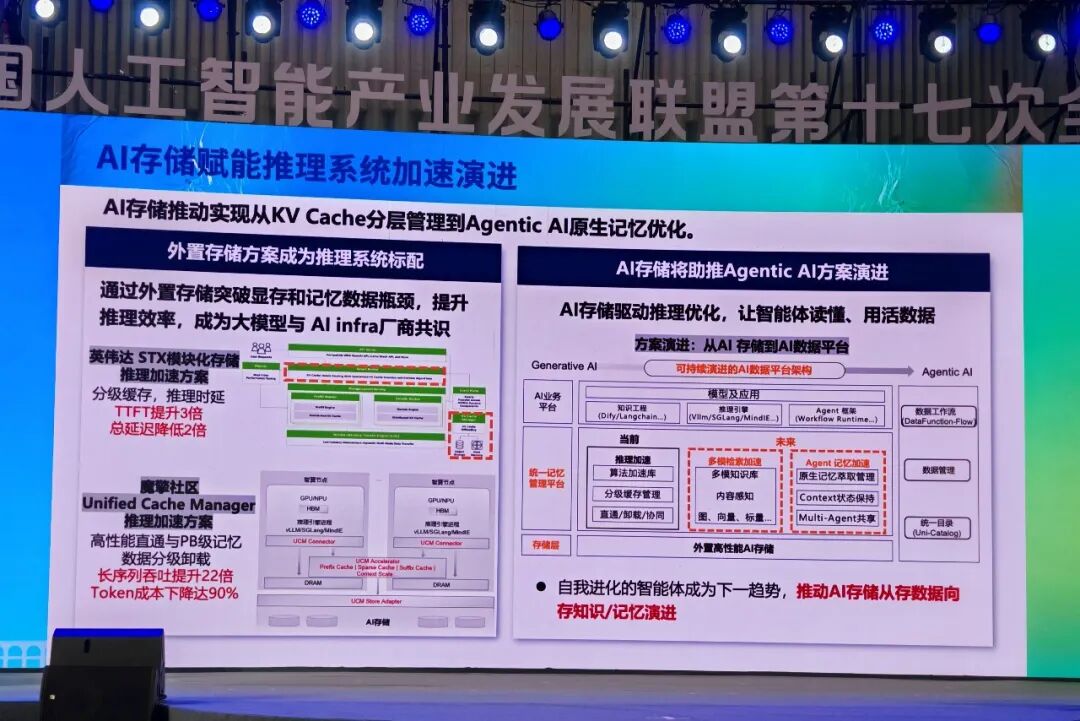

《大模型推理优化关键技术及应用实践研究报告》中明确指出:AI存储是赋能推理系统加速及长期演进的核心引擎,外置存储方案成为推理系统的标准配置。 这一趋势将助力企业在时延、精度、成本及资源等多重约束下,实现AI推理基础设施的优化升级。

会议期间,华为闪存存储领域副总裁刘坤岭作为报告编制代表,受邀发表主题演讲。他重点针对大模型推理应用中的三大瓶颈——知识质量不足、长序列推理体验差、推理记忆缺失,介绍了华为如何通过打造AI数据平台破除数据门槛:

华为闪存存储领域副总裁刘坤岭

知识生成与检索:针对企业数据更新慢、决策不准的痛点,华为AI数据平台构建了端到端的数据管道。通过多模无损解析与Token级编码,将碎片化资源转化为细粒度知识,结合多维检索与重排序技术,实现超过95%的知识检索精度。

UCM推理加速:针对长文本、高并发下的响应迟缓问题,AI数据平台基于UCM(推理记忆数据管理器)提供全局分层缓存能力,实现数据在HBM、DRAM与存储间的按需流动。有效避免重复计算,将首Token时延降低90%,大幅提升推理吞吐。

记忆萃取与召回:针对大模型“易遗忘”的通病,华为AI数据平台提供了精准的忆萃取与召回能力,实现上下文状态的长期保持。通过对信息的凝练与沉淀,让大模型在应用中实现自我进化,“越用越聪明”。

本次发布,标志着我国在大模型基础设施建设标准化进程中迈出了坚实一步。作为AI数据基础设施的先行者,华为通过打造AI数据平台,不仅解决了模型推理的效率与精度难题,更通过存储技术的创新,为行业智能体的规模化落地提供了强力支撑。未来,华为将持续深耕AI数据底座,加速千行万业迈向通用人工智能时代。

评论区

登录后即可参与讨论

立即登录