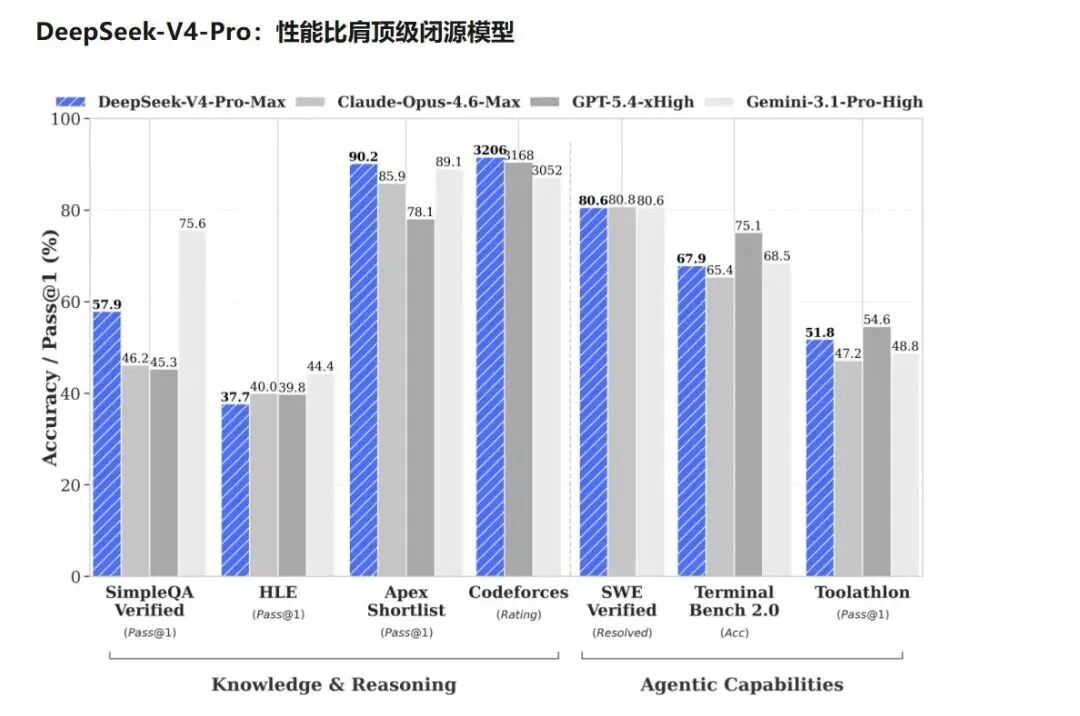

今日,DeepSeek-V4正式开源发布,将模型上下文窗口提升至1M,使模型在长序列推理与复杂任务链处理中的表现更加高效与稳定。华为AI数据平台深度适配DeepSeek-V4,将进一步推动大模型从实验阶段走向生产级应用。

DeepSeek-V4发布

带来KV Cache存储的全新挑战

DeepSeek-V4新版本支持100万Tokens的上下文能力。为提升上下文理解能力同时控制显存占用,DeepSeek-V4在模型各层级引入非定长比例压缩机制,推理数据流从整齐划一的“方阵”变为大小不一、动态分布的非定长数据,对底层硬件提出苛刻要求:非定长IO混合并发,催生了海量的随机读写请求,整体IOPS压力大幅飙升;推理输入序列变长,TTFT也随之增加,对KV Cache加载效率也提出更高要求。

面对DeepSeek-V4这种“非定长、高并发、强随机”的IO狂飙,传统基础设施往往因IOPS瓶颈和显存溢出而陷入“推理慢、部署难”的泥潭。欲载“万亿”之智,必先利其全栈之器。

为了打破这一瓶颈,华为凭借对AI负载的深度理解,AI数据平台中推理加速的核心组件UCM(推理记忆数据管理)适配DeepSeek-V4,并进一步提升推理效率。这并非简单的模型适配,更是一场从存储架构到推理应用的“存算协同”进化。其中关键能力更新:

智能IO聚合:在存储与算力节点间构建动态调度引擎,通过智能IO调度算法,自适混合IO大小,对碎片化数据块实时收拢、重组规整,将大量随机读写转化为高效顺序流转,大幅削减 IOPS 负载压力。

PMR-TREE(智能后缀联想):在DeepSeek-V4的MTP(多令牌预测)基础上,通过构建复用树与高效后缀检索,进一步压缩无效计算、提升候选序列质量,在论文综述、摘要提取等场景中,推理吞吐提升30%以上,全面加速模型推理效能。

存算协同:依托OceanStor A系列高性能AI存储底座,实现从存储到显存的零拷贝式传输,KV Cache数据无需在内存中搬运,直达算力核心,实现存取效率跨域式升级。

在大模型迈向百万级长文本、万亿级参数的爆发时刻,华为数据存储始终坚守自主创新,深耕存算协同,通过系统级架构创新,释放出超乎想象的效能潜力。

华为AI数据平台不仅可助力DeepSeek等顶尖模型攀登性能高峰,更致力于将昂贵的训推效能转化为千行百业的生产力,实现AI技术在千行百业的规模化落地。

评论区

登录后即可参与讨论

立即登录