此前电子工程专辑多番撰文提及,OpenClaw龙虾乃是AI推理发展到一定程度后爆发的一大现象级应用——它实际上是生成式AI之后,经过多轮技术与市场累积,代理式或智能体AI(Agentic AI)的阶段性发展成果。

即便我们先前就提过,至少现阶段对个人用户而言,龙虾的实用价值还算不上很大,但它可能一定程度证明了智能体AI的发展路径是正确的。

所以最近Intel提出的“智能体PC”概念也就很好理解:它是“进阶版”AI PC,是具备“意图理解、任务分拆、工具调用、反复迭代执行、记忆保持全链条执行”能力的AI PC。

高宇(英特尔中国区技术部总经理)在采访中说,“2023年Intel首次提出AI PC概念时,大语言模型刚刚兴起不到一年”;相对的,现在这个时间点,”智能体PC大规模普及还有一段路要走”,“技术和生态成熟还需要时间”——在龙虾热度稍稍退去、市场回归冷静之际(从搜索引擎关键词搜索趋势看,4月份OpenClaw热度已从尖峰走向了平稳),“提出智能体PC的概念恰是最佳时机”。

那么本文就尝试谈谈,所谓的“智能体PC”是营销噱头,还是智能体AI的未来载体?

“智能体PC”形态及构成

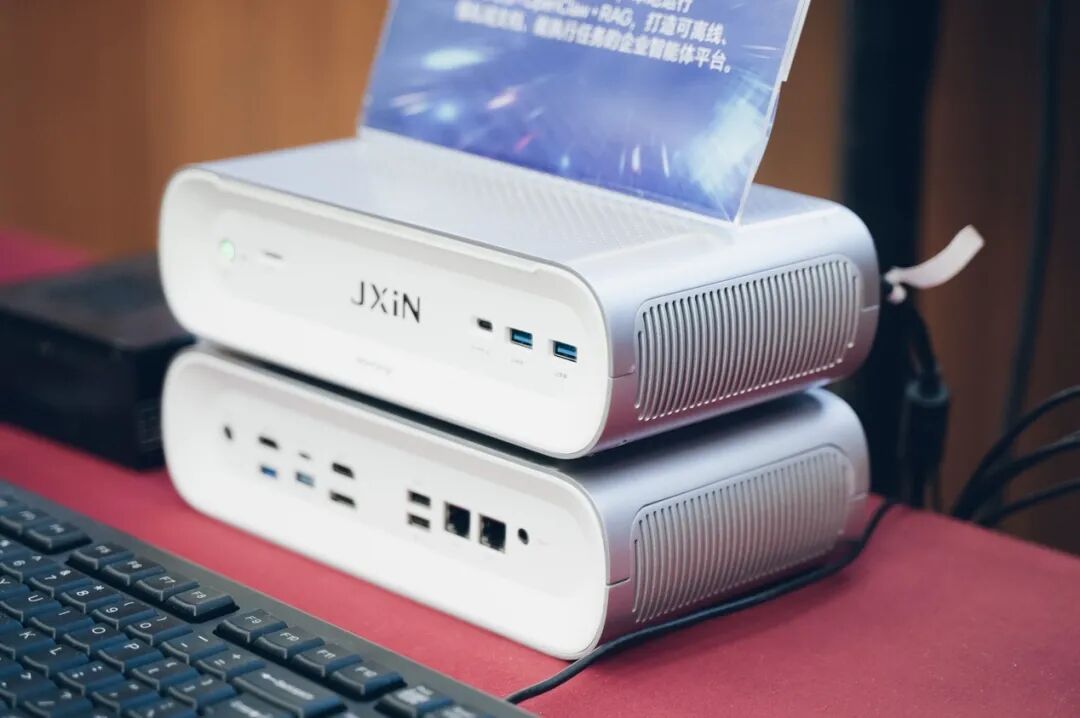

单纯从设备形态来看,Intel在媒体会活动现场展示的“智能体PC”实际上也就是笔记本(更偏重轻薄本)、mini PC、AI NAS、边缘AI盒子等设备。除了再宣传一波酷睿Ultra处理器的AI性能,好像也没什么特别;但其中更关键的部分,在软件及其构成的全栈能力上。

下面这张图给出了Intel眼中传统PC和“智能体PC”之间的区别。高宇总结为“传统PC是人类使用工具,需要人类学会操作”,“而智能体PC是人类数字分身,理解和学习人类”。我们自己总结这张表格表达的核心思路是,AI成为人机交互的主要入口,具体执行过程不再或更少需要人类关心。

比如其中提到记忆方式,传统PC要求用户记住文件在哪儿、系统设置怎么做,需要人类用户去主动适应;而智能体PC能够记住用户偏好、操作习惯、说话风格、工作节奏,主动适应人类。再比如,应用呈现方式上,传统PC有办公软件、浏览器等各类应用;而智能体PC不再需要用户关注具体的应用,“只看‘任务流’和‘工作流’”即可...”

还有交互方式,传统PC依赖固定指令输入——无论是键盘还是鼠标操作,“用户需要全程在线,一旦不操作,电脑就停了”;而智能体PC通过自然对话来理解用户意图,“用户不在的时候,自己把活儿干了”,并给出结果......

这是个非常理想的PC交互与工作方式展望,它实际面临着各种技术和商业模型上的挑战;但它的确描摹了智能体AI时代,PC存在方式的另一种可能性;以及从Intel的角度来看,走向这一步,现在该做些什么。

上述这些+对AI的可靠性和安全性要求,Intel眼中的智能体PC需要有4个关键能力:本地智能体实现任务闭环的能力;端云结合的混合AI推理能力;具备记忆和自主进化能力;以及具备本地安全保护能力——主要是要解决OpenClaw此前面临的数据隐私、高危操作等安全问题。

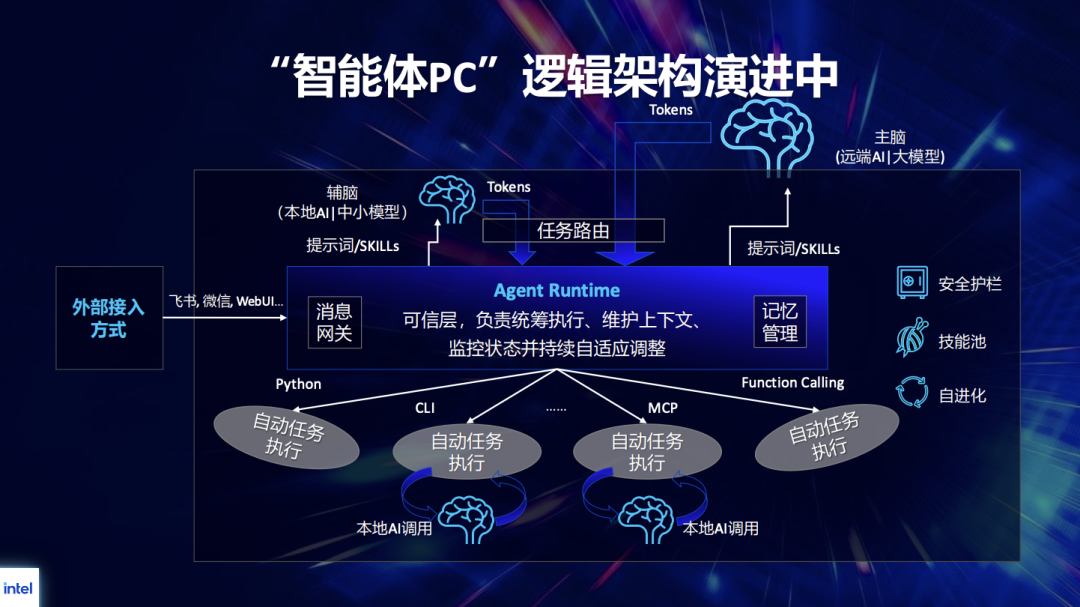

将这些能力落实到智能体PC之上,则其逻辑架构应该是下图这样的:

这张图的大部分构成,实际上就是龙虾或智能体AI的简化版模型

中间有个Agent Runtime,为智能体提供运行环境,进行任务调度、维护上下文、监控状态;其北侧连接云上AI大模型(主脑);南侧末端连接执行器——无论是运行脚本、命令行CLI,还是藉由MCP服务或功能调用本地API等;与用户交互(西侧)则通过外部接入进行,可以是web端或即时通讯应用...

整个过程是用户以自然语言提出需求,Agent Runtime经过处理后将其转发给云上AI模型;主脑推理过后进行任务分解、下发;最终由执行器做任务执行;“执行结果再经过大模型分析处理,判断任务完成度并规划下一步工作...”,“循环往复”,“直到把任务完成”。

关键要素之一的Skill——即执行某一类工作的“说明书”,能够给予大模型更明确的提示,令结果更符合预期;不同的Skill可用于完成不同的工作。

只不过“智能体PC”的完整形态,在此基础上增加了几笔。比如Agent Runtime的北侧还有个辅脑——这个辅脑就是PC本地的AI模型——相对没那么复杂的工作(如新闻搜集这类日常任务)可交由它处理;而“任务路由”机制会决策使用云上还是本地AI能力——Intel预期“30%以上的任务”可以在本地完成;

另外,南侧的末端执行过程,也可以由不同的本地AI模型参与其中(如ASR、TTS、OCR等);以及,Intel在这张图右侧增加了一些特性:为确保安全和隐私的“安全护栏”、可拓展的Skill技能池、自动化能力。这个思路和许多商业级类龙虾方案是大致相似的。

那么为达成这样的逻辑架构,Intel具体是怎么做的?

粗看几个关键要素

一般芯片企业提出一个偏应用方向的指导框架,其自身能提供的主要还是芯片或所谓的“算力底座”。不过这件事在半导体发展的近现代真的不大一样,尤其AI时代,芯片企业需要插手更多的技术栈上层工作。所以Intel说,“智能体PC不仅是算力平台,更是一套全新的软件架构”——其中涵盖“AI模型加速支持、封装好的API,抽象好的原子化基础能力”等…

虽然Intel没有在媒体活动上详解智能体PC逻辑架构所有组件的全貌,不过我们还是能从中看到一些零散的信息。除了依托QwenPaw、QClaw、Workbuddy等现有智能体AI应用或服务的配合,这里根据在活动现场抓住的信息,略谈有关智能体PC的几个关键要素(1)硬件算力基础;(2)上层模型支持;(3)端云协同;(4)本地安全保护能力;(5)Skill技能扩展...———这些也基本能对应前文提到智能体PC的4个关键能力。

Intel将mini PC、AI NAS、一体机、边缘网关和“其他系统集成的AI Box”都定义为智能体PC的存在形态;轻薄本在其中被Intel寄予了作为“智能体PC”的厚望

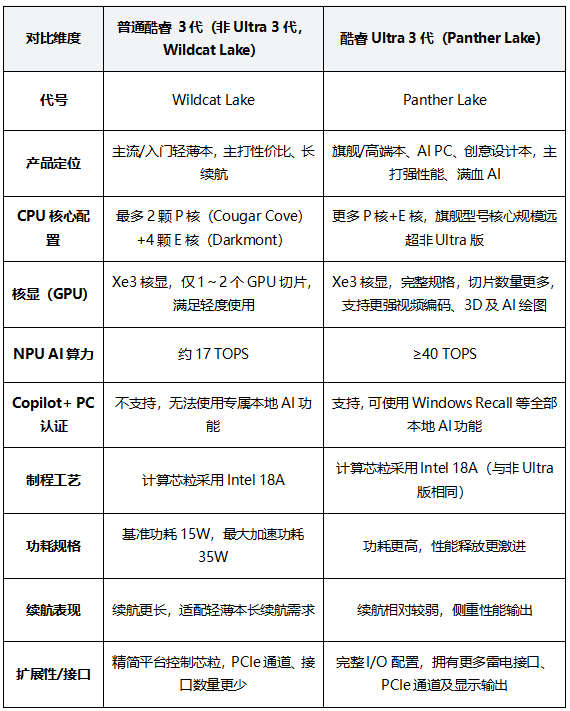

(1)首先是底层硬件,除了我们已经熟知的这一代AI总算力最高180TOPS的Panther Lake(第三代酷睿Ultra处理器),Intel还特别谈到了40TOPS INT8算力的Wildcat Lake(第三代酷睿处理器,CPU至多6核心、核显2个Xe3核心、带NPU5)——这是个面向入门市场的CPU产品;以及平台可组合低至12GB/16GB容量的DRAM。这些应该是为了实践和强调“智能体PC”的普惠,“人人可入手”、并非高端PC专属这一思路。

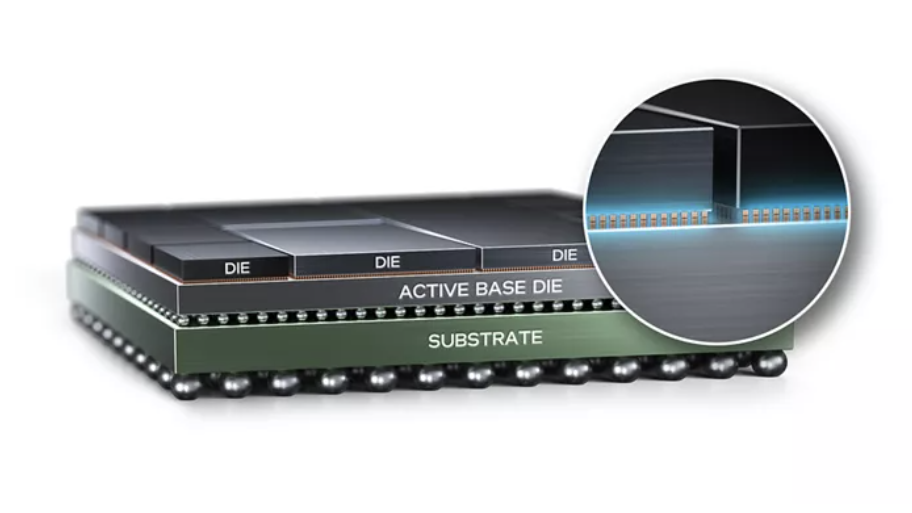

不过这里强调的,应当并不只是当代酷睿/酷睿Ultra处理器的AI算力、平台的统一内存架构(最高可将92%以上内存作为显存,为iGPU所用),以及可以藉由AI SSD来实现MoE模型关键数据层offload以缓解内存压力(将MoE的“冷专家”offload到SSD的技术);更在于软件层面的努力。

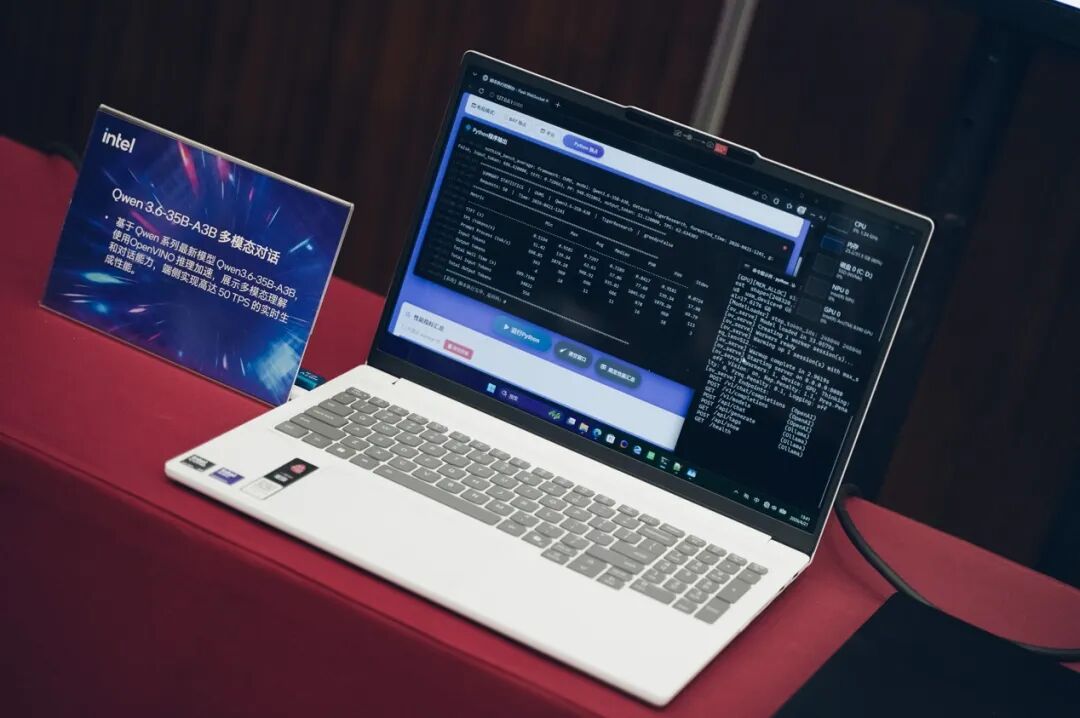

(2)而就软件部分,Intel这次倒是没怎么谈AI技术栈及模块,而是特别提及对于最新的Qwen3.6-35B-A3B模型和其他适用于智能体AI的模型的支持。高宇说Qwen3.6-35B-A3B模型在智能体和编程能力方面提升显著,“我们认为目前端侧运行模型的最优解就在35B上下”,“35B是个甜蜜点”。

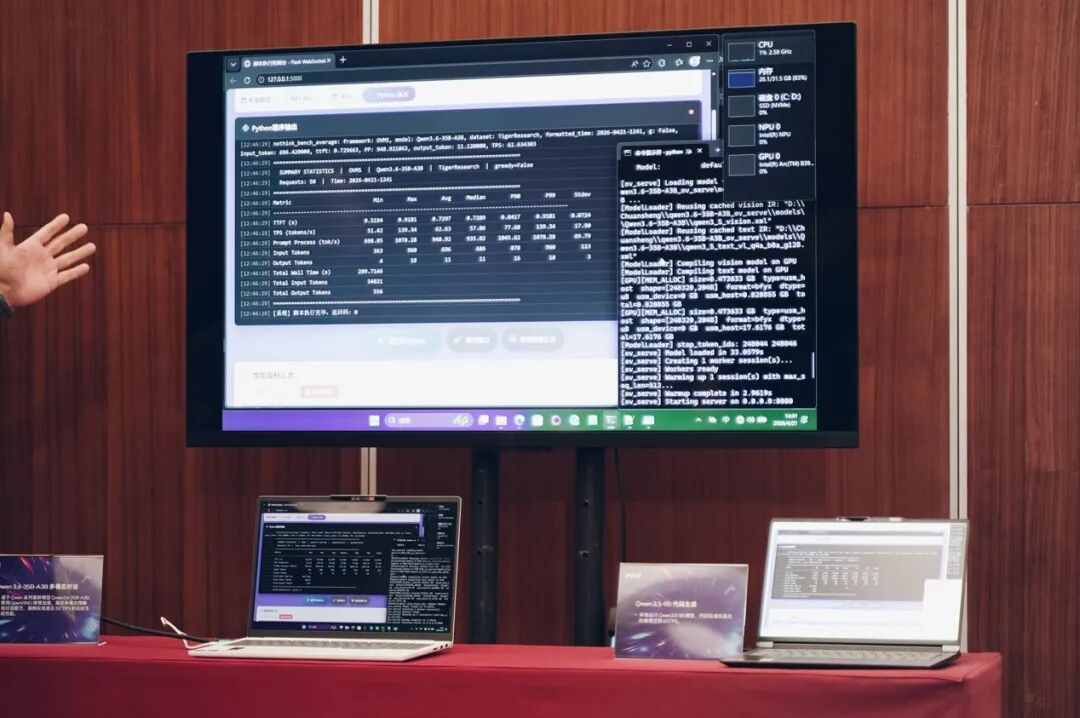

Intel给出的数据是,在酷睿Ultra X7 358H + 32GB DRAM配置方案下,跑Qwen3.6-35B-A3B模型可达成>50 tokens/s的输出速度,最大上下文窗口>128K(“龙虾要求很长的上下文”,“满足复杂和生产环境需求,就需要128K”),“目前可以胜任本地龙虾的复杂任务需求。”

酷睿Ultra X7 358H + 32GB DRAM配置配置的其他参考数据还包括Z-image-turbo文生图512x512可做到5秒出图;跑Qwen3-Omni多模态模型——文本、图片、声音混合输入,得到20+ tokens/s的文本输出速率...

高宇表示,这些都是跑在功耗受限的轻薄本上的成绩,“大众最多接触到的形态就是轻薄本”,如此才能体现智能体PC的“亲民”;而不只是普遍认知中可作为智能体设备的mini PC或其他AI Box。

轻薄本承载的AI模型智商水平和推理效率达成曾经云上AI才有的高度,实际上是全产业链共同努力促成的,包括底层芯片。国际电子商情2025年4月刊的封面故事中,我们就说达到相同智商的AI模型token推理成本这几年下降了1000多倍,是AI技术栈自上至下的高速发展所致。

基于第三代酷睿Ultra处理器平台的不同配置,对于不同AI模型的支持情况;包括在上述逻辑架构中,作为本地辅脑的LLM,和执行器可能涉及到不同的多模态模型...

虽然这次Intel没怎么谈在中间件及模型适配上所做的努力,不过演示环节,Intel技术专家提到了这样一句话:“利用(iGPU)高吞吐的XMX矩阵计算能力,对Transformer做针对性加速;结合OpenVINO混合精度量化,降低计算与带宽压力;通过KV cache与内存优化,减少自回归过程中的重复计算”,“这套组合拳才有了这样的效果。”

这句话本身只是比较泛的软硬结合技术阐述:但让这些模型高效地跑在酷睿Ultra处理器上,其中浓缩的Intel在软件方面的工作量应该也是相当大的;所幸,自2023年的Meteor Lake(酷睿Ultra 1代)起,Intel就在软件层面构建AI基础设施(如OpenVINO),在后续的AI技术浪潮中越来越显现出价值。

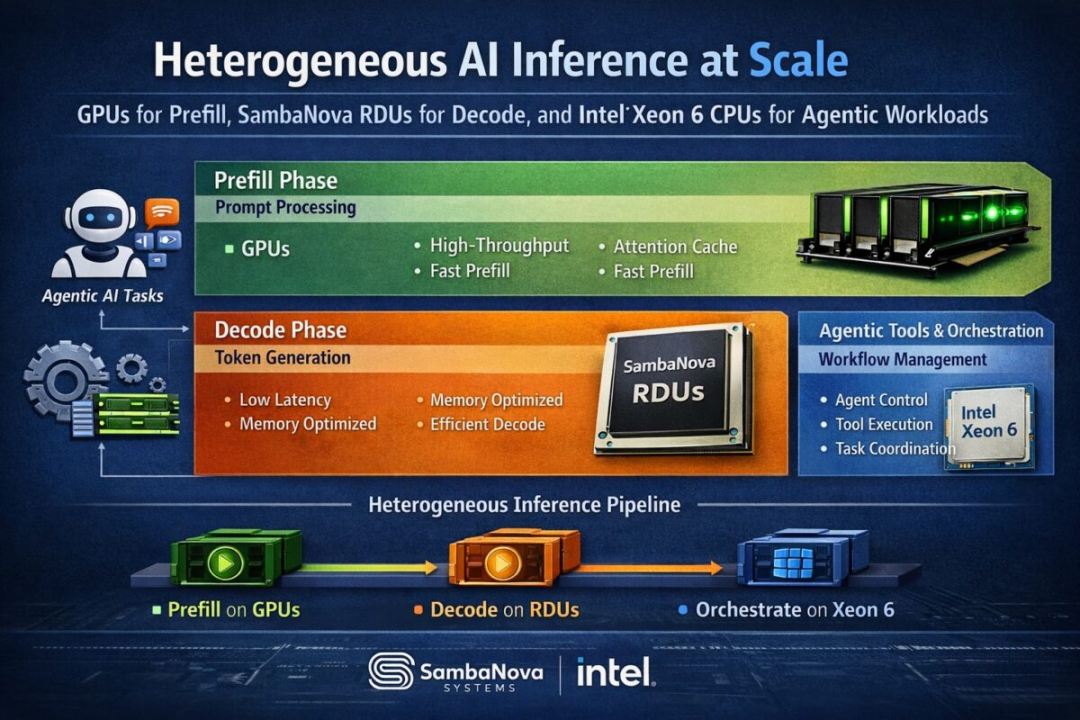

(3)第三,强调端-云混合AI。即除了端侧本地要做涉及隐私安全、更具成本效益的AI推理,还需要云来做更复杂、涉及更长上下文的AI任务处理。今年的Intel人工智能创新应用大赛据说就特别新增了“混合AI赛道”。

就端侧部分,大部分搞边缘或端侧AI技术的企业,普遍在谈边缘/端侧AI推理的价值在于安全、隐私、延迟等;而在智能体AI时代,Intel还强调端侧智能体AI的价值在于“成本”——即智能体AI对于token的巨量消耗及对应所需的成本投入,是端侧推理可予以缓解的。

“边缘”大概并不仅限于集成iGPU和NPU的酷睿Ultra PC,还可以是加入了Arc独显、Gaudi加速器,或者采用至强CPU的边缘系统;比如图中基于Arc Pro B60的方案;Intel给至强W+Gaudi 2E多卡AI推理系统的定位是>200B模型推理,10亿token日产能;乃至还有基于至强6的多龙虾(“龙虾湖”)实例支持...

而云上部分则补充了端侧AI智能水平受限的缺憾——这应该还是Intel第一次就AI PC概念范畴,特别去肯定云上AI的价值。这大概也表明了智能体AI时代的算力需求、token消耗的确是上了新的台阶;而这种混合AI,显然是AI智能水平与成本投入的折中之选。

前面的逻辑架构图就明确了,其中有个任务路由会决策使用云上还是本地AI能力。高宇在采访中解释说,对于这部分路由的实现,Intel会提供核心技术思路,应用的最终实现要交由开发者去完成。

其基本逻辑是由AI模型来判断当前任务需求适合本地还是云上执行:除了可以遵循Skill指示来直接执行,还“可以用本地Qwen3.6-35B模型(辅脑)做判断,或者我们内部也在考虑用更小参数量的4B模型,速度会更快”。

粗略计算活动现场演示的7个智能体AI演示demo——包括TTS、ASR、OCR、生图、生视频等,总token消耗量据说就将近1000万了

(4)第四,本地安全保护能力。这一点理论上应该类似于企业级龙虾方案的基于策略的隐私和安全guardrail,以及尝试令智能体的行为更加可控。虽然我们不清楚这部分Intel具体是怎么做的,不过活动现场,Intel给出了两个涉及安全与隐私的demo。

其一是让智能体AI去对某个目录做总结,其中部分PPT文档标识“机密”字样——在有安全护栏的情况下,AI就不会将这些数据外传;其二是用户要求龙虾自身恢复到某个历史状态,LLM主脑可能将其理解为删除数据,在没有安全护栏的情况下,开启自毁模式——而安全护栏则通过语义理解,防止此类操作发生。

“我们会将PoC成果分享给商业化软件厂商。”高宇在谈智能体PC的安全防护能力时说,“将Intel的设计思路和技术优势,转化为合作伙伴产品中具体有效的安全防护设置。”最终具体如何实施,也要看商业软件厂商的决策。“现在的龙虾通过Skill实现安全护栏”,而未来智能体AI的这类涉及隐私与安全的特性,有机会快速走向标准化。

技术专家甚至还提到,Intel正考虑硬件级安全实施方案,比如“对特定敏感数据或核心操作进行隔离保护”,乃至“对关键数据构建灾难恢复机制”——只不过这些“前沿安全方法仍在内部研发阶段”。

完善Skill和智能体PC生态

(5)第五,就是Skill技能扩展,是为智能体PC实现各种复杂操作的“说明书”;或者也可以理解为智能体PC之上的应用。媒体活动现场,Intel就Skill构建,给出了资料抓取与总结、文字转语音TTS、本地视频编辑、发票OCR与归类整理、安全护栏、生图生视频、在线视频内容ASR转录与总结等demo展示...

其中的部分Skill已经在开源社区上线:比如对在线课程视频做结构化内容整理的Skill(流程是抓取在线视频文件,将音频转为wav,经由ASR转录,再基于大模型做结构化内容生成——梳理学习要点);再比如本地的文生图Skill、OCR Skill、热搜摘要Skill等...

Intel期望从3个层面来构建自有生态内的不同Skill,如上图所示。这显然属于智能体PC生态完善的一环。如高宇所说“繁荣Skill生态是智能体PC发展的大前提,也是大模型能够聪明地调度本地AI能力的关键路径”。

最上层“甄选Skill”是Intel自己打造的——此前一直在宣传的智能搜索(Helicon Search)、视频粗剪、游戏辅助,以及前述安全护栏都在其中;其次是Intel工程师基于最佳实践开发的“能够调用本地AI原子化能力的Skill”,如ASR, OCR等——面向开发者,作为参考Skill存在;更大范围还有社区Skill,基本形式就是构建生态的常见操作:社区竞赛、校园计划、技术培训等。

大概是为了展示智能体AI的未来潜力,Intel在活动最后还给出了“家庭AI大脑”计划及其概念展示:AI Box可作为满足家庭场景的7x24服务中枢,核心思路是智能体PC的扩展;其中融入了诸多Skill,语音问答、信息查询、智能家居操控都算是常规,还有像是OpenWRT Skill查看家用网络流量与诊断信息;调用家中的摄像头找猫;智能体理解并使用NAS中的数据剪辑短视频、发朋友圈等…这总体上应该是个融合了Intel软硬件解决方案的参考设计…

高宇说,基于现有Skill和vibe coding,Intel在此次活动上展示的Skill“最多1天时间都开发出来了”;如此,AI技术本身也就让AI创新应用大赛、Skill大赛的门槛大幅降低,并有机会令AI应用创新更快速、频繁地涌现;

这大概也是智能体PC有较大概率更快出现具备实用价值乃至杀手级应用的基础。即便前文提到Intel眼中智能体PC的理想形态,在我们看来还存在着技术与商业模型的诸多现实问题——其实践难度可能比2023年至今Intel打造的AI PC生态更高——或者其未来演进方式是否如Intel预期也是未知数;

但智能体PC概念和逻辑架构的提出,及生态构建已经是个出色的开端:且“以混合AI的部署方式让智能体人人可及”的思路也清晰明确。

与此同时,这些还需要产业链上的诸多参与者联动共建,如应用开发者、操作系统厂商、OEM厂商,及所有AI相关的服务供应商——尤其市场到现在仍然广泛存在类龙虾智能体AI应用的易用性问题——这些也都是Intel正尝试牵头商业化龙虾落地方案、构建智能体PC生态的一部分。

“我们认为,这是一个正确的时间点——‘智能体PC’时代的大门才刚刚打开。”要让智能体PC“从工程师的玩具变成大多数人可用的工具”,大概还需要一些时间。不过一旦智能体PC的市场价值与潜力成为行业共识;则从生成式AI爆发至今这短短几年的历史经验来看,这个时间应当不会太久。

评论区

登录后即可参与讨论

立即登录