对于很多家庭来说,宠物不是动物,是家人。

它是孩子放学回家第一个扑上去的伙伴,是深夜加班时趴在脚边的温暖,是全家出游照片里永远抢镜的毛孩子。

可每次开车出行,却不能总是将爱宠带在身边——受限于旅途颠簸、出行时间等等制约,车里装了导航、音乐、空调,却装不下最想带的那份陪伴。

在开发座舱功能时,我们不仅希望它足够好用,也希望它是有温度的:为了满足车载空间内宠物陪伴的需求,小米大模型应用团队自研了视觉生成 Agent Vision Forge,打造了新一代 SU7 座舱内的真实宠物数字化身功能——只需上传一张家里宠物的照片,AI 就能为你生成一只专属的 3D 萌宠,入驻你的车机桌面。

萌宠功能也出现在了雷总的直播中,现在,让我们一起来看看这个好玩又有趣的功能是怎么开发出来的吧:

01

轻触即现,宠伴旅程

在新一代小米 SU7 的智能座舱中,我们在座舱超级玩具箱中加入了萌宠功能,除了 YU7 上预制的可爱小水獭与卡皮巴拉外,新增了猫、狗、鸟等新的形象;除了固有形象外,我们也考虑到用户想要把自己宠物上传,亲自制作虚拟形象的需求,依赖于小米大模型生成技术,这一需求在新一代 SU7 中也得到了实现。

现在,只需要打开小米汽车 APP,上传一张自己宠物的照片,稍等几分钟,就可以生成可爱逼真的专属萌宠形象,可以一键 Pin 至车机屏幕,成为专属副驾。

相比于简单的 AI 生成效果,小米技术与产品团队在座舱萌宠上进行了深度的打磨,效果有明显的不同;具体来说,生成的萌宠形象具备高还原性、高灵动性与高自然度。

-

高还原性:制作虚拟形象,最关键的是要与真实对象相像。依托于小米自研的生成 Agent Vision Forge 的模型理解能力,在萌宠形象生成过程中,模型会深度提取宠物的专属特征,如颜色、斑纹、耳朵形状、眼睛间距,甚至鼻头的湿润感等,通过深入细节的理解,保障了模型高还原性的生成,让虚拟宠物可以被一眼认出。

-

高灵动性:虚拟宠物并不简单是真实宠物形象的复刻,在高还原性基础上,我们在 Agent 生成引擎中,加入了大量宠物“萌感”要素的提炼,不仅让生成的萌宠更加可爱,还赋予其在屏幕上的“生命力”——它会眨眼、摇尾、动起来,会随着点击屏幕即时做出反应。

-

高自然度:在小米汽车 APP 中生成的萌宠形象,可一键传输至车机,与车机背景融为一体, Vision Forge 中具备高精度抠图融合能力,可以将生成的萌宠自然地“放置”在车机背景中,无论怎样切换背景,它始终稳稳地坐在屏幕当中,仿佛真的趴在仪表台上。

02

自研生成 Agent 打造萌宠技术底座

新一代 SU7上的虚拟萌宠保真而又灵动的效果,都离不开其内部的大模型生成 Agent:Vision Forge,在技术开发上,小米内部技术团队将图像生成、视频生成、图像视频的分割与融合等多种技术,通过大模型 Agent 进行组合使用,并在用户关注的毛发细节、光影效果上进行像素级优化,最终输出沉浸式车载萌宠视频。

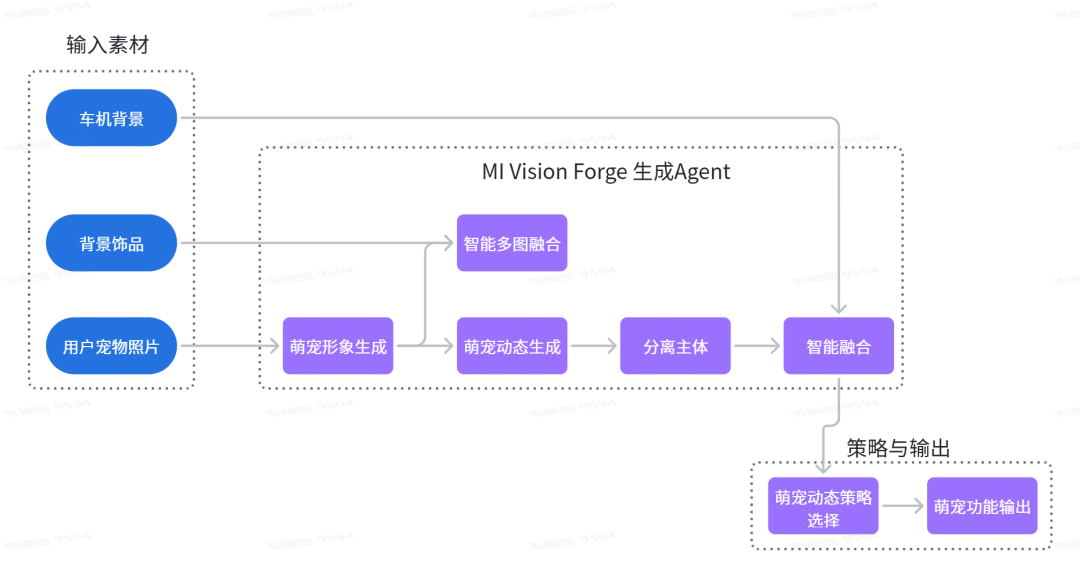

用户的萌宠照片与车机背景图、饰品图作为图像输入,经过 Vision Forge 系统处理,生成萌宠虚拟形象与对应的动作,并融合入车机环境,再经由智能动态策略挑选,输出眨眼、摇尾等生动姿态,完成功能的效果输出。对应形象效果的高还原性、高灵动性、高自然度,生成 Agent 在萌宠形象风格化、萌宠动作生成、高精度主体提取上,均进行了对应的技术改造。

**▍**萌宠形象生成:风格「构图师」****

Vision Forge 中具备图像生成模型,同时具备对原始萌宠图像的深度理解能力,尤其是能够代表宠物特征的花色、瞳色、斑纹等,抓住宠物核心样貌特征,做到高精度的理解与还原。

在精准保留宠物 IP 特征(如毛色、斑纹、耳朵、眼睛间距甚至鼻头湿润感)的基础上,技术团队收集调研了当前社会潮流的美学风格,将美学渲染能力内置于模型中,在保证宠物高还原度的基础上,赋予其柔和讨喜、生动治愈的视觉质感;两者结合,实现了高质感的萌宠形象。

萌宠形象的灵动活泼不单来源于其本身,萌宠与背景的衔接同样重要,在制作这一效果的过程中,小米技术团队的目标就是让萌宠始终如一地陪伴,提供沉浸式的感受。Vision Forge 中的融合模型会自主分析环境光影,自动化实现毛色与背景色调的细腻交融,同时确保宠物始终处于视觉焦点,与背景和谐统一,稳稳“卧”在屏幕一角,营造出“它就趴在那里”的真实感。

**▍**萌宠动作制作:动效「造梦师」****

让萌宠灵活的动起来,需要依赖 Vision Forge 中的视频生成模型,技术团队针对萌宠形象,进行了特定的强化学习技术优化,可控的萌宠动态生成,让不同物种的萌宠从静态照片中“活”起来,且生成动态与宠物类型契合,符合各自的“宠设”。对视频模型的一些关键的技术优化包括:

-

MoE-LoRA 深度定制:引入了 MOE 混合专家架构,并行构建多个轻量级专家网络,智能匹配不同物种的动态特征(如猫的灵动、鸟的轻盈),有效解决单一模型过拟合问题,实现零切换推理,自动生成契合物种属性的高质量视频。

-

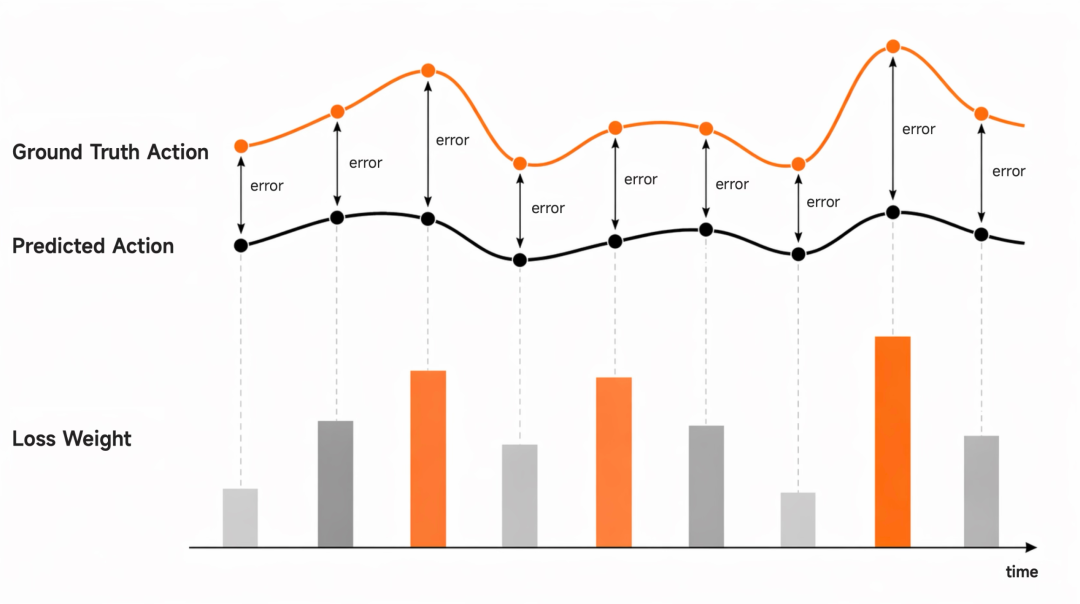

强化学习**增强动态**:自研了 ACC-FlowGRPO 算法结合奖励模型,通过改进 SDE 流程提升计算准确性,并融合多模态大模型作为奖励信号,避免传统小模型的 hacking 问题,使萌宠动态向更高质量、更生动的方向收敛。

-

数十**倍推理加速**:联合算法工程多步骤进行推理优化,并结合特征缓存与算子量化,实现数十倍的推理加速,通过大幅压缩动效生成时间,降低整体功能排队时间,为用户带来流畅的使用体验。

最终,每一只萌宠都能在车机屏幕上自然眨眼、摇尾、卖萌,让沉浸式、有温度的视觉交互体验触手可及。

**▍**高精度萌宠提取:细节「微雕师」****

沉浸式的萌宠陪伴体验,还需要萌宠形象与座舱车机环境自然的融为一体,而萌宠往往有非常大量而细节的毛发,这对 Agent 中的自动融合模块提出了挑战。自研技术团队打造了一套端到端视觉抠图模型与高精度前景估计算法,对宠物毛发细节进行精细提取,力争保住宠物的每一根毛发。

与传统的提取融合方式不同,在萌宠技术链条中,技术团队摈弃了传统“主体检测—前景分割—透明度估计”的繁琐流程,采用端到端大模型方案,一次性完成区域定位、边界分割与透明度数值估计,直接输出高精度 alpha mask。由此实现两大突破:毛发根根分明——即使是风中凌乱的绒毛也能精准标记透明度,边缘细腻自然,毫无“纸片感”;像素级透明度——每个像素携带精确透明度数值,让萌宠叠加任何背景时都能呈现真实的半透明效果,在光影配合下,可实现耳廓透光、毛发蓬松晃动等拟真效果。

同时,针对抠图场景频频出现的颜色泄漏(如“绿边”或“黑边”)问题,团队设计了一套高精度的边缘处理算法,彻底消除色边,确保萌宠主体与背景无缝咬合;并智能修正偏色影响,让毛色与光照环境完美匹配。最终,无论是静止图像还是动态视频,萌宠都如真实存在般稳稳“坐”在屏幕里,与车机界面融为一体。

03

技术赋能,做有温度的体验

值得一提的是,开发这一功能的小米大模型应用团队,本身就是一群养宠物的工程师,这里有养猫的产品经理,有养鹦鹉的算法工程师,还有人养狗、养鱼……正是这份对宠物的真挚热爱,让团队得以将前沿 AI 大模型生成技术,转化为有温度、有情感的座舱萌宠功能。

小米大模型应用团队始终坚信 “技术赋能美好”,希望座舱萌宠能够成为小米汽车车主全家喜爱的 “虚拟毛孩子”:在孩子乘车过程中,虚拟萌宠可陪伴孩子度过旅途时光,成为默契玩伴;在情侣同行时,萌宠可见证甜蜜时刻,为旅途增添乐趣;而对于那些已离开的宠物,虚拟萌宠更能成为车载场景中永恒的回忆,延续那份温暖陪伴。

新一代 SU7 的座舱 AI 萌宠生成是小米座舱 AI 生成应用的一个节点,未来,小米技术团队将持续探索生成大模型 Agent 在座舱中的应用形态,继续为小米车主打造有温度、有感知的产品体验。

评论区

登录后即可参与讨论

立即登录