泰凌微发布TL721X:支持谷歌LiteRT、TVM开源模型的端侧AI平台

公司发布的基于TL721X系列芯片的TL-EdgeAI平台,支持谷歌LiteRT、TVM等开源模型,是目前世界上功耗最低的智能物联网连接协议平台。其芯片已在谷歌(Google)的Pixel Bud Pro 2智能耳机方案中被采用。公司将继续深化与谷歌的合作关系。

围绕三大核心,布局端侧AI领域

在端侧AI领域,泰凌微的布局围绕核心芯片研发、配套开发平台搭建、多场景市场落地三大核心展开,形成了一套完整且具有前瞻性的发展体系。

泰凌微推出的基于TL721X的TL-EdgeAI平台,是其在端侧AI领域的重要技术成果。TL721x SoC增加了边缘AI运算能力,使得芯片具备了本地智能处理的能力,无需依赖云端计算,大大提高了数据处理的效率和安全性。TL-EdgeAI平台则支持主流本地端AI模型,如谷歌LiteRT、TVM等开源模型,为开发者提供了丰富的开发资源和便捷的开发环境。这一平台不仅是目前世界上功耗最低的智能物联网连接协议平台,更是为海量AI端侧应用的发展铺就了崭新道路。

为了更好地推动端侧AI技术的发展,泰凌微还推出了机器学习与人工智能发展平台TLEdgeAI-DK。该平台将支持主流本地端AI模型,为开发者提供了一站式的开发解决方案,降低了端侧AI应用的开发门槛,加速了端侧AI技术的普及和应用。

在应用场景方面,泰凌微的端侧AI芯片目前主要应用于音频领域,如无线麦克风等。随着产品的迭代与场景的落地,未来将逐步拓展至录音设备、智能家居、电动工具、汽车电子、资产跟踪等更多场景。这种多场景的布局,不仅为泰凌微的端侧AI芯片提供了广阔的市场空间,也为其在不同领域的技术积累和产品创新提供了更多机会。

TL721X系列芯片是泰凌微的明星产品,专为蓝牙低功耗(LE)和802.15.4设计。其内置的2.4GHz收发器支持蓝牙低功耗、802.15.4以及2.4GHz专有操作,支持蓝牙LE、Zigbee、Thread、Matter、2.4GHz专有标准等多种标准和工业联盟规范。

该系列芯片将高品质无线物联网设备所需的特性和功能集成到单个系统级芯片中,具有高集成度、超低功耗的特点。它集成了强大的32位RISC-V MCU、512或256 KB SRAM(包括高达256 KB的保留SRAM)、2 MB(2048 KB)或1 MB(1024 KB)嵌入式闪存(具体取决于详细型号)、12位ADC、PWM、灵活的IO接口以及其他物联网应用所需的周边模块。这种高集成度使得外部组件需求极少,能够满足客户对超低成本的要求。

未来规划,IoT、无线音频、边缘AI多领域布局

在无线物联网系统级芯片市场竞争激烈的当下,泰凌微通过技术创新与结构优化保持产品的核心竞争力与毛利率水平。其核心优势主要体现在三方面:一是芯片尺寸优势,核心芯片尺寸小于竞争对手,能有效降低成本;二是核心IP自主化,公司拥有大量自主核心IP资源,降低了IP相关费用支出;三是高毛利产品占比提升,AI产品和音频芯片的快速发展为公司毛利率高位运行提供了有力支撑。

此外,公司正自研WiFi芯片,未来将重点应用于智能家居场景,进一步完善产品矩阵,增强系统级解决方案能力。

对于未来发展,泰凌微有着清晰的战略规划。公司将围绕物联网芯片领域,立足这个规模巨大的市场,把握物联网设备需求爆发的产业机遇,在IoT、无线音频、边缘AI等多个领域深度布局。

在AI领域,公司后续的重点将聚焦端侧AI芯片的算力提升与场景适配能力。随着产品迭代与场景落地,泰凌微在端侧AI领域已形成的先发优势将进一步凸显,未来2 - 3年有望维持高增速,持续贡献营收增量。

音频芯片方面,泰凌微将继续加大投入,做好新品的开发与迭代。同时,公司还将自研WiFi芯片,主要应用于智能家居场景,进一步丰富其产品线,提升在智能家居领域的市场竞争力。这三大方向将成为公司未来的核心增长点,为公司的发展注入强大动力。

相关推荐

人工智能 MIPS S8200 RISC-V NPU:赋能自主边缘物理AI的最新技术解析

· MIPS S8200 NPU 现已向开发自主边缘运输、机器人及嵌入式平台的主要客户出样· MIPS 赋能通用的端侧 AI 能力,支持现代模型以及具备业界领先的效率2026****年1 月 14 日

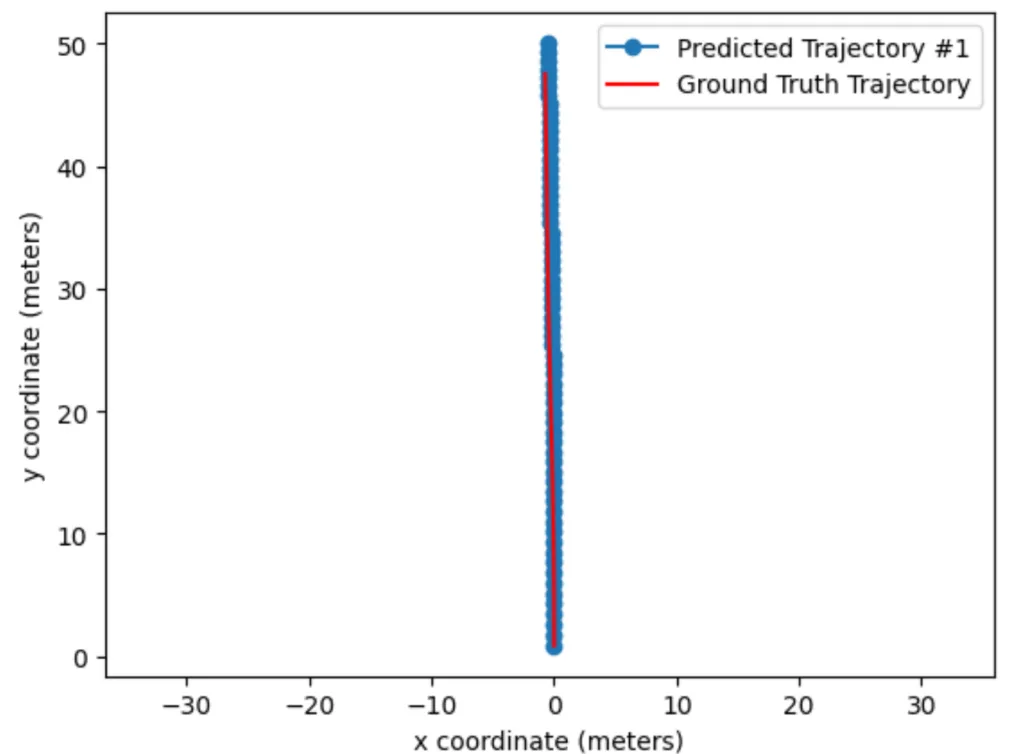

人工智能 NVIDIA Alpamayo:基于VLA推理模型的辅助驾驶解决方案

辅助驾驶研究领域正经历一场快速变革。视觉-语言-动作推理模型(Reasoning VLA) 的出现正重塑该领域,这些模型为辅助驾驶决策赋予了类人的思维能力。这类模型可视为在语义空间中运行的隐式世界

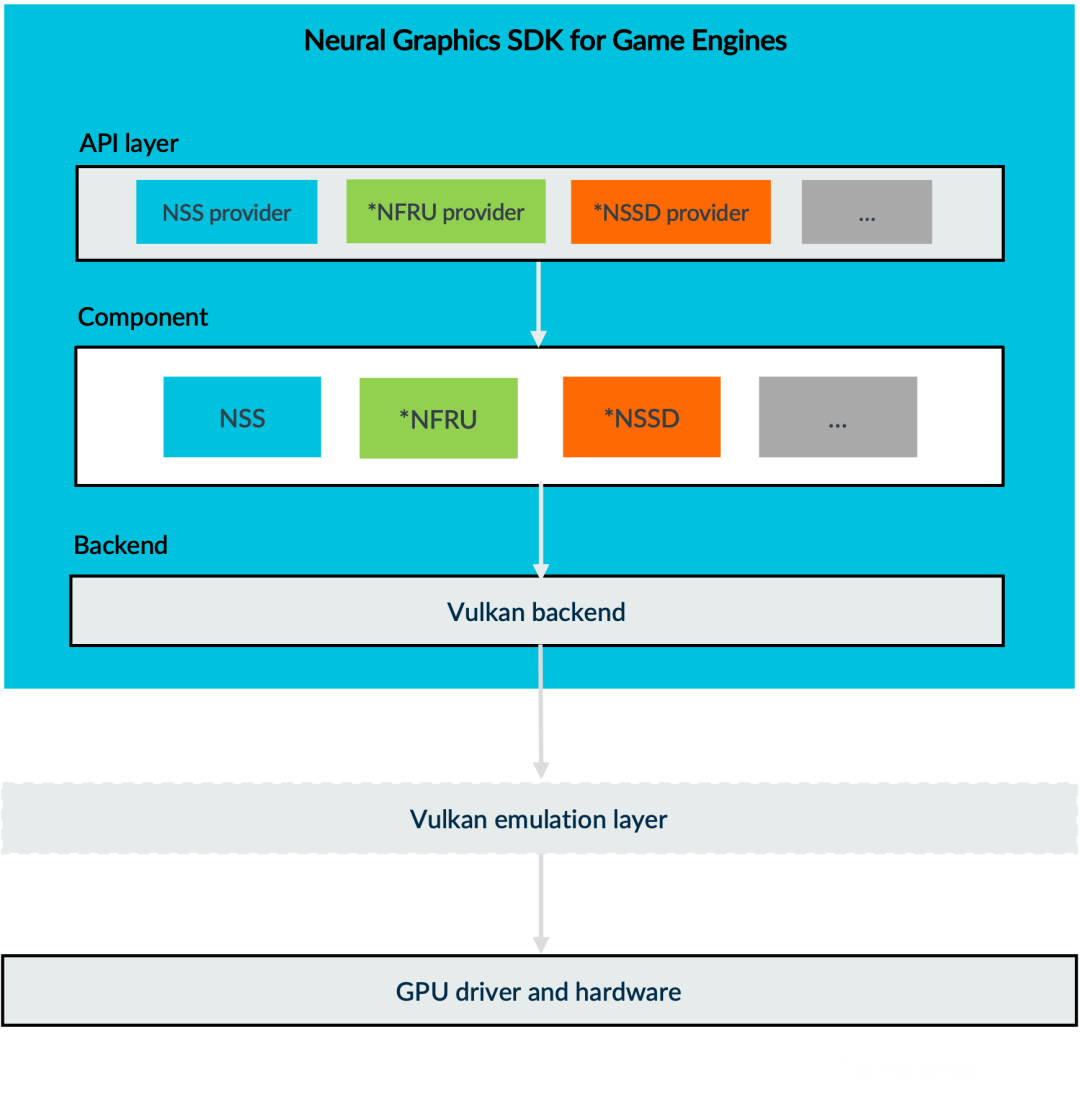

人工智能 Arm推出面向游戏引擎的神经图形SDK及UE5.4的NSS插件

作者:安谋科技高级软件技术经理 杨喜乐 2025 年 8 月,Arm 在 SIGGRAPH 大会上发布了突破性的 Arm 神经技术。这是业内首次将专用神经加速器集成到 Arm GPU 中,搭载

人工智能 高通骁龙8Gen5 AI影像提升40%:超域融合视频技术详解

(电子发烧友网报道 文/章鹰)10月11日,在中国移动全球合作伙伴大会上,高通展示最先进的骁龙8Gen5至尊版芯片、AI眼镜方案、XR设备的芯片方案、5G-A基带芯片,还有在手机领域,高通与虹软公司在

人工智能 天数智算AI存储解决方案:UbiPower 18000性能提升50%

在AI大模型训练、超算中心算力升级、生物医药科研等领域,你是否正面临这样的困境:数据量呈指数级增长,存储系统却频频“掉链子”—— 带宽不足拖慢训练进度,IOPS瓶颈导致计算卡顿,扩容复杂让业务扩展举步

人工智能 Tensilica Vision 230 DSP助力AX8850N:提升人形机器人与边缘应用性能

近日,楷登电子 Cadence 与边缘 SoC 领军企业爱芯元智共同宣布,爱芯元智在其最新的 AX8850N 平台上集成了 CadenceTensilicaVision 230 DSP,以共同推动

人工智能 闪迪SN861 NVMe SSD及UFS4.1:2025年AIoT存储解决方案详解

(电子发烧友网报道 文/章鹰)12月19日,OFweek 2025(第十届)物联网产业大会在深圳成功举行。本届大会以“万物智联,赋能数字中国”为主题,邀请各领域专家和行业领先企业代表,共同探讨如何推动

人工智能 光帆科技发布AI摄像头耳机:集成摄像头与实时语音交互

光帆科技发布了首款AI摄像头耳机,集成了高分辨率微型摄像头、双麦克风阵列、本地AI芯片及低功耗蓝牙音频模块,支持第一视角记录、实时语音交互和场景理解等功能。

人工智能 海思物连HS-Ultra 7L2D:99TOPS高算力AI边缘计算工控机发布

海思物连推出HS-Ultra 7L2D系列边缘计算工控机,搭载Intel Arrow Lake处理器,提供高达99TOPS的AI算力,适用于工业、医疗等多种场景。

人工智能 华为AI数据平台支持DeepSeek-V4,定义大模型推理效能新高度

今日,DeepSeek-V4正式开源发布,将模型上下文窗口提升至1M,使模型在长序列推理与复杂任务链处理中的表现更加高效与稳定。华为AI数据平台深度适配DeepSeek-V4,将进一步推动大模型从实验阶段走向生产级应用。 DeepSeek-V4发布 带来KV Cache存储的全新挑战 DeepSeek-V4新版本支持100万Tokens的上下文能力。为提升上下文理解能力同时控制显存占用,DeepS

人工智能 AI Infra 基础知识 - NVLink 入门

NVLink是一种专有系统互连硬件,可促进多个 Nvidia GPU 和支持CPU之间的一致数据和控制传输。 概述 NVLink 于 2014 年初发布,旨在作为 PCI Express 的替代解决方案,具有更高的带宽和附加功能(例如共享内存),专门设计用于与 Nvidia 自己的多 GPU 系统的 GPU ISA 兼容。在推出 NVLink 和 Pascal(例如Kepler)之

人工智能 具身智能关键一跃:让AI真正“触碰”物理世界

图源:Freepik “具身智能(Embodied Intelligence)”这个多少有点抽象的名词在过去一年里出镜率极高。2025年更位列为中国的十大关键词Top 3。进入2026年,马年的春晚上演了一波智能机器人闹春晚的名场面:从行云流水的武术功夫,到盘核桃、捡玻璃碎片、货架取物等精细化操作,再到生活化的叠衣服、串烤肠,他们全都轻松拿捏,动作灵巧且自然拟人。这进一步推高具身智能的话题热度。

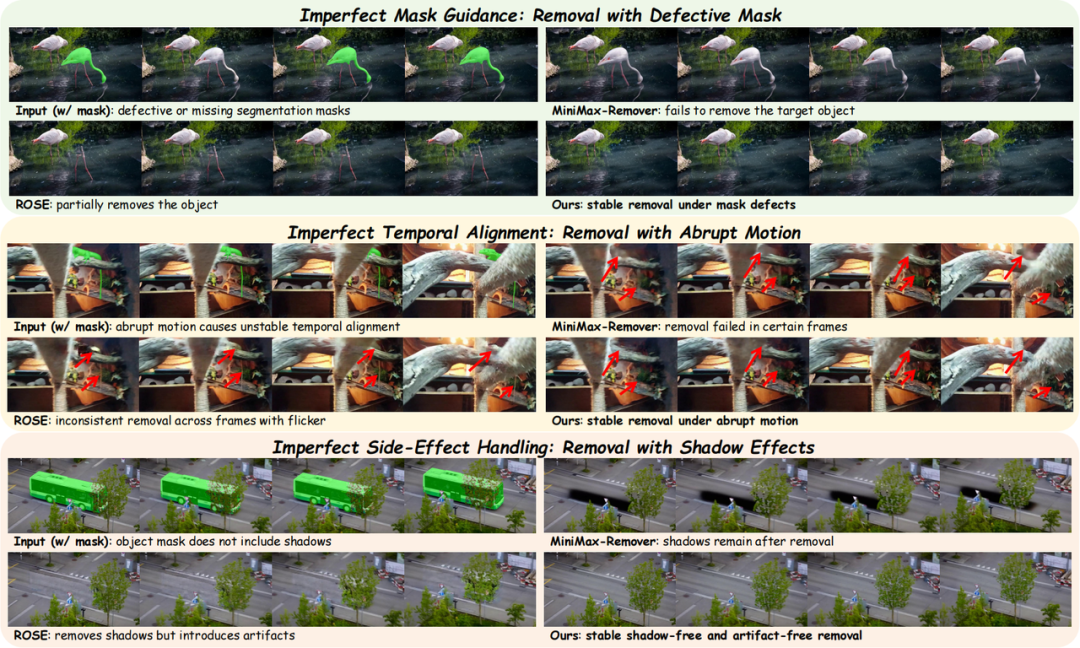

人工智能 CVPR 视频消除夺冠!小米开源视频消除神器 SVOR,专治三大顽疾

视频目标消除是一个非常实用的技术:当你在美丽的风景里拍了一段视频或 livephoto,而回看的时候发现画面中有不希望出现的内容(比如路人),这时景色已经变换无法再次拍摄,甚至已经离开了拍摄地点,视频消除技术可以挽救你的不完美视频。 在实际研发视频消除任务的过程中,我们发现了一个普遍存在的问题:现有的方法大多在理想条件下设计和验证,而真实世界的视频远比论文里的测试场景复杂——模型识别的掩码边缘不够

人工智能 AI穿戴硬件,串起你的碎片时间

周末的公园,阳光正好。孩子像一颗不知疲倦的弹球,在滑梯、沙坑和秋千之间来回发射。你站在三米开外,一个标准的“家长守望位”。身体是放松的,但神经像一根绷着的橡皮筋-孩子冲向人群的瞬间,爬高到危险边缘的刹那,都需要你0.5秒内做出反应。这时候,口袋里那个万能的小方块,忽然变得很尴尬。掏出来?解锁,点开,目光刚沉入屏幕,孩子可能已经跑到视线盲区。不掏?滑梯排队的一分钟,秋千荡起的几十个来回,这些碎片时间

人工智能 从被动响应到主动预判:如何构建真正以人为中心的AI系统

图源:Adobe 智能闹钟能够贴合人类的自然睡眠节律,在适合的时机轻柔唤醒用户。数字助手则会在人们拿起设备之前,就提前准备好天气预报、整理关键信息,并将日常安排规划妥当。通过此类设备,人工智能(AI)已悄然融入人们的日常生活,在后台自动执行各项日常任务,几乎无需人工干预。 从晨间例行事务到工作任务,智能系统正在重塑人们的生活方式和思维模式。智能家居通过持续的反馈学习用户习惯,在用户提出需求之前就预

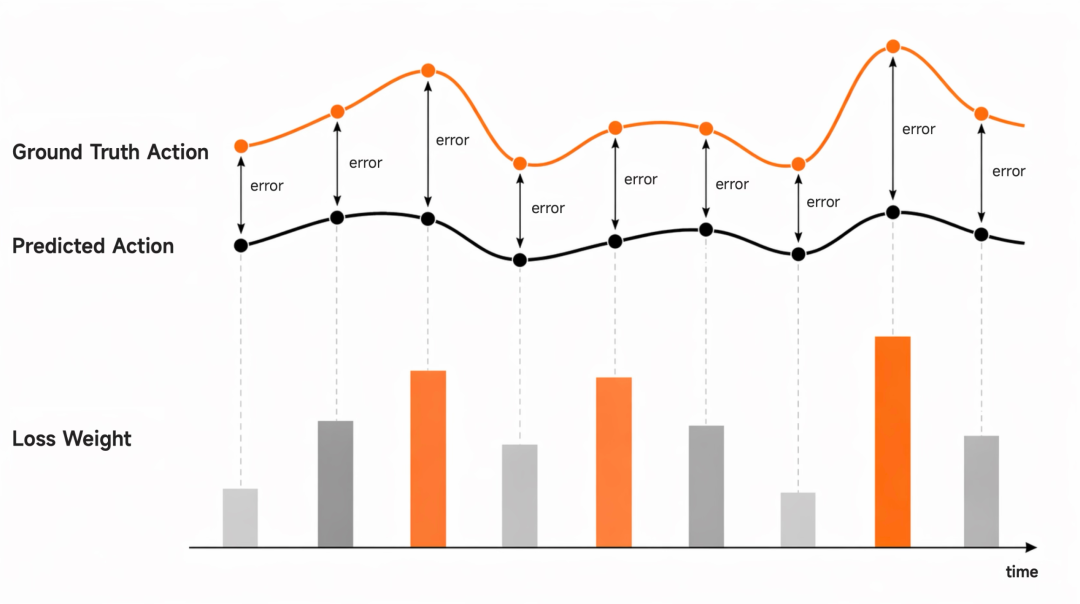

人工智能 小米具身模型真机后训练开源,小米机器人的“丝滑秘籍”也尽数交给你

两个月前,我们发布了 Xiaomi-Robotics-0 模型,并深度分享了其在复杂工业场景中的实战经验。模型发布首月就在 HuggingFace 全球 VLA 模型下载榜斩获第六名。 看到 Xiaomi-Robotics-0 在全球开发者手中释放潜力,我们深受鼓舞。为了让其真正成为“开箱即用”的生产力利器,今天我们给大家带来新的能力演示并正式发布 Xiaomi-Robotics-0 真机后训练(

人工智能 谁拿下边缘 AI,谁就更可能赢下整个 AI 时代

本文介绍了边缘AI。 过去两年,AI 行业的热闹几乎都集中在云端。大家都在比模型参数、训练数据、算力规模和推理能力,好像只要把数据中心堆得够大,AI 的未来就会水到渠成。但一个时代真正的转折点,往往不出现在最喧嚣的地方。 高通 CEO 克里斯蒂亚诺·阿蒙在2026年网络峰会和达沃斯论坛上反复强调的一个观点,值得整个行业停下来认真想一想: AI 最终的胜负手,未必在云端,而在边缘。 这话从一家芯片

人工智能 摩尔线程完成DeepSeek-V4全链路工程化适配:S5000基于MUSA+SGLang实现复杂MoE模型快速落地

近日,摩尔线程依托旗舰级AI训推一体智算卡MTT S5000与自研MUSA软件栈,基于SGLang 开源推理框架,成功完成DeepSeek-V4的完整运行验证。该成果表明,面向新一代MoE大模型,摩尔线程已构建起从硬件架构核心计算引擎承接、热点算子支持**,**再到端到端部署验证的系统化适配链路,验证了国产GPU平台对前沿大模型“框架级兼容、开箱即落地”的承载实力及工程化落地能力。 随着大模型架构

人工智能 目标说话人识别大模型,让车外语音“聚精会神”听懂你

你有没有遇到过这样的尴尬? 在停车场场景下,当你对车辆说出 “小爱同学,锁车” 时,若旁边路人随口发出类似 “关闭”“停” 的语音,传统车外语音方案可能出现误触发;而当你手持物品走向车尾,说出 “小爱同学,打开后备箱” 时,受移动状态与环境噪声影响,指令也可能出现识别不完整、响应不及时的情况。 这些问题表面看是“车外太吵”,本质上其实是一个更难的技术挑战——“鸡尾酒会”**场景下的目标说话人语音识

人工智能 为什么AI需要专门的硬件加速?从GPU,TPU到LPU的技术演进全景

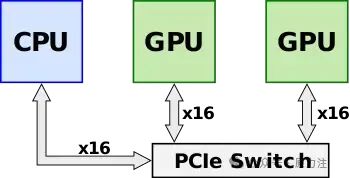

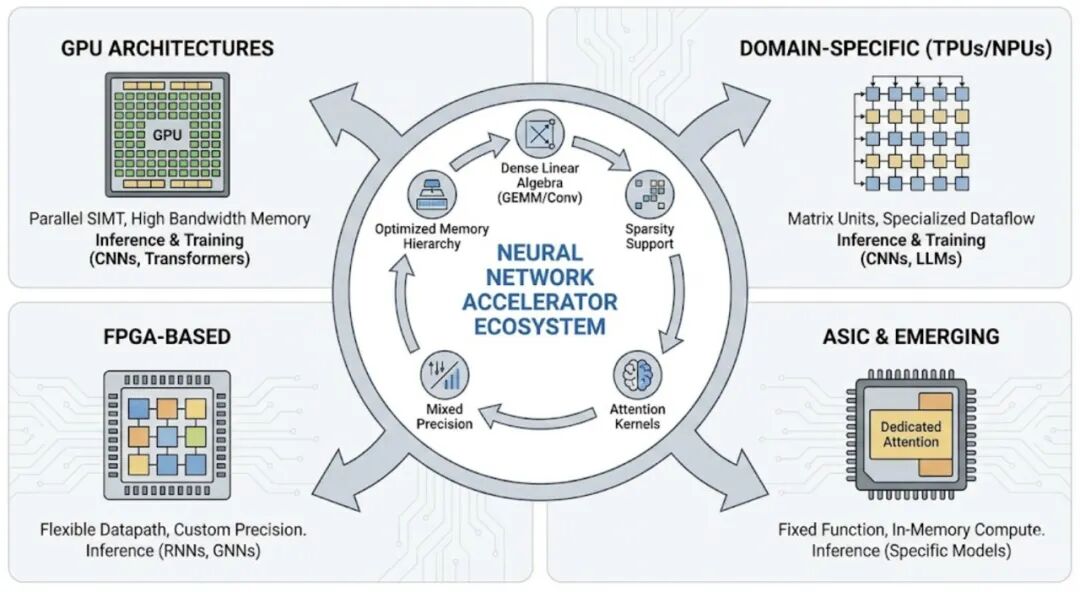

本文介绍了从GPU,TPU到LPU的技术演进全景。 为什么AI需要专门的硬件加速? 聊AI芯片之前,先想明白一个问题:为什么CPU跑AI这么慢? 本质上,神经网络计算就是海量的矩阵乘法和卷积运算。这些运算的特点是计算密度高、并行性强,但控制逻辑简单。 CPU设计目标是通用计算,强大的控制单元和缓存层次用来处理复杂的分支和随机内存访问,但拿来跑矩阵乘法就像用跑车拉货,不是不能干,就是效率太低。 硬

评论区

登录后即可参与讨论

立即登录