Compass AI **平台何以丝滑?安谋科技“周易” X3 打通端侧大模型开发“最后一公里”**

硬件是端侧 AI 的骨架,而软件生态是其血肉。即使拥有领先的硬件架构,若缺乏易用、开放的软件工具链,开发者仍需面对“适配难、周期长、门槛高”的困境——例如某智能汽车厂商曾为适配一款端侧 NPU,花费 3 个月调试模型兼容性,最终因无法自定义核心算子而放弃。安谋科技“周易” X3 NPU IP 配套的Compass AI 软件平台,通过“全流程工具链 + 开源核心组件 + 自定义能力”的设计,彻底打通了端侧大模型开发的“最后一公里”,让开发者从“硬件适配”转向“应用创新”。

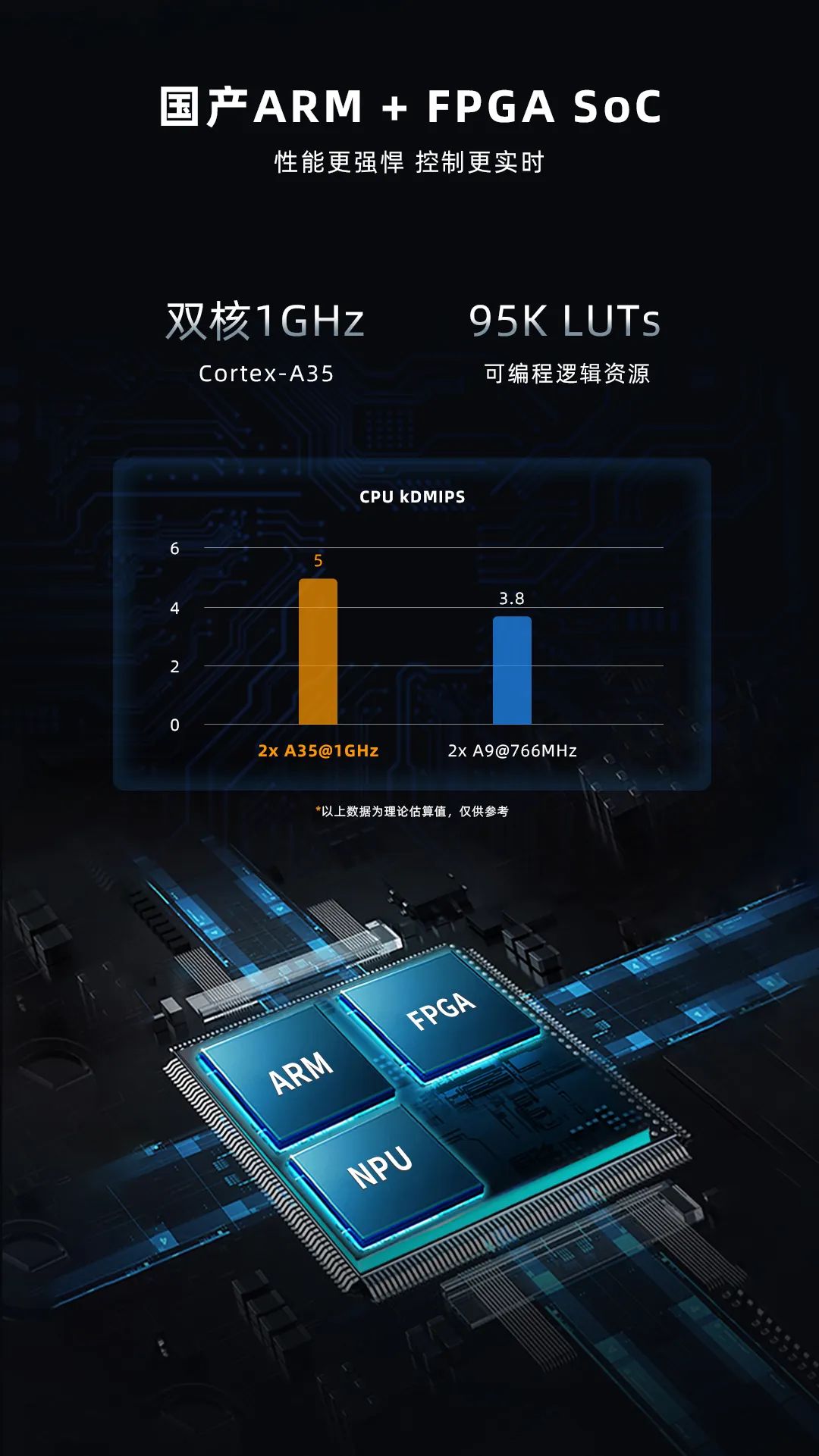

“周易”X3 NPU IP亮点

Compass AI 平台的核心突破在于打破了传统 NPU 工具链的封闭性。传统端侧 NPU 厂商多提供“黑盒”工具链——开发者只能上传模型、获取推理结果,无法查看中间优化过程,若遇到兼容性问题(如算子不支持、精度不达标),只能依赖厂商技术支持,响应周期长达数周。而 X3 将 Compass 平台的核心组件全面开源,包括模型解析器(Parser)、优化器(Optimizer)、Linux 驱动(Driver)及内部 IR(中间表示)格式,开发者可通过白盒调试查看模型转化的每一步细节:例如 Parser 如何将 PyTorch 模型转化为 IR 格式,Optimizer 如何进行算子融合、内存优化,从而快速定位问题。某 AI 创业公司反馈,采用开源组件后,模型适配问题的排查时间从 7 天缩短至 4 小时,开发效率提升 40 倍。

针对端侧大模型开发的核心痛点——模型适配效率低,Compass 平台推出了“AIPULLM 大模型运行工具链”,实现 Hugging Face 模型的“一键部署”。Hugging Face 作为全球最大的开源模型库,拥有数万款大模型(如 Llama、Qwen、DeepSeek),但这些模型多为云端格式,需经过格式转换、量化优化、算子适配等多步处理才能在端侧运行,传统流程需专业算法工程师操作,耗时 1~2 周。AIPULLM 工具链通过自动化脚本,可直接从 Hugging Face 下载模型,自动完成格式转化(如从 Safetensors 转为 ONNX)、量化优化(如 GPTQ 量化、W4A8 混合精度)与部署配置生成,整个过程无需人工干预,耗时仅需 15 分钟。实测显示,通过 AIPULLM 部署 DeepSeek-R1-Distill-Qwen-1.5B 模型,开发者仅需执行 3 条命令,即可在 AI PC 上实现流畅的文生文对话,推理延迟低于 300 毫秒。

为覆盖多样化的开发需求,Compass 平台构建了全场景的模型与框架支持体系。在算子层面,平台支持 160 + 种 AI 算子,涵盖 CNN(卷积、池化)、Transformer(注意力、LayerNorm)、多模态(跨模态注意力、图像 tokenizer)等各类结构,可满足从传统图像识别到前沿 VLM(视觉语言模型)的开发需求;在模型层面,平台提供 270 + 种预适配模型的“Model Zoo”,包括 Stable Diffusion(文生图)、MiniCPM(多模态)、MoE(混合专家模型)等,开发者可直接调用,无需从零优化;在框架层面,平台兼容 TensorFlow、PyTorch、ONNX 等主流 AI 框架,同时支持 TVM、TFLite 等第三方推理引擎,避免开发者因框架限制而重构算法。某智能物联网厂商利用 Compass 平台,仅用 2 周就完成了智能 IPC 中 MiniCPM 模型的部署,实现了“图像识别 + 图生文描述”的多模态功能,而传统方案需 2 个月以上。

Compass 平台的另一大亮点是支持深度自定义开发,为客户核心算法提供“安全屏障”。在端侧 AI 领域,开发者的核心算法(如智能驾驶的决策模型、医疗设备的诊断算法)是其差异化竞争的关键,需严格保护知识产权。平台通过DSL(领域特定语言),允许开发者编写自定义算子——开发者无需了解底层硬件细节,只需通过简洁的语法描述算子的计算逻辑(如自定义注意力机制),DSL 编译器会自动将其转化为硬件可执行的指令,同时确保算法细节不泄露。此外,平台还支持开发者基于开源的 Parser 与 Optimizer,打造专属的模型编译器,实现个性化的优化策略(如针对某类医疗图像的特殊量化方法)。某医疗设备厂商利用 DSL 开发了自定义的病灶检测算子,在保护算法隐私的同时,实现了比通用算子高 30% 的推理效率。

为缩短产品上市周期,Compass 平台还提供硅前(pre-silicon)仿真工具。传统芯片开发中,开发者需等待芯片流片完成(通常需 6~12 个月)后才能进行软件调试,若发现硬件与软件不匹配,需重新流片,成本高达数百万美元。X3 的硅前仿真器可实现“比特级精确”的硬件模拟——开发者在芯片流片前,即可在仿真环境中测试模型的性能、精度与兼容性,提前发现并解决问题。某芯片设计公司利用仿真器,在芯片流片前就完成了 80% 的软件调试,流片后仅用 1 个月就实现了产品量产,上市周期缩短 6 个月。

在易用性上,Compass平台让X3变得“好用”。其核心的AIPULLM工具链可以支持开发者从Hugging Face上下载模型,并完成一站式转化和部署,极大降低了开发门槛。同时,平台还支持GPTQ等大模型主流量化方案,让模型的快速适配成为可能。

在定制化上,Compass平台让用户真正“用好”X3。安谋科技Arm China深知,对于客户而言,最高效的算法往往是他们差异化的护城河。为了赋能客户,同时保护他们的知识产权,Compass平台采取了深度的开放策略。

从生态视角看,Compass AI 平台的价值不仅在于“降低开发门槛”,更在于“激活创新活力”。通过开源核心组件、支持自定义开发,安谋科技将硬件能力开放给千行百业的开发者,让每个场景的需求都能转化为具体的应用创新——这正是端侧 AI 从“技术探索”走向“产业落地”的关键。正如安谋科技产品研发副总裁刘浩所言:“软件生态的开放不是技术妥协,而是让 IP 真正成为‘计算基座’,赋能伙伴打造差异化产品。”

评论区

登录后即可参与讨论

立即登录