NEWS

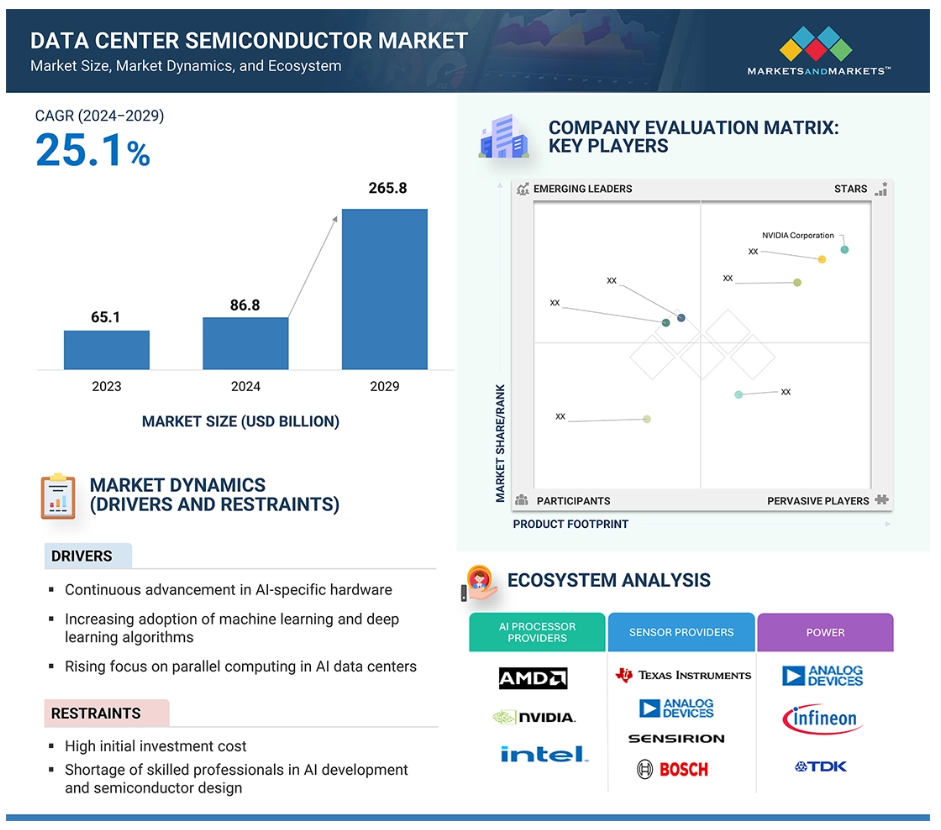

MarketsandMarkets最新分析报告预计,全球数据中心半导体市场规模将从2024年的868亿美元增长至2029年的2658亿美元,2024-2029年复合年增长率(CAGR)达25.1%。

市场增长的核心驱动因素包括:AI及生成式AI工作负载的快速扩张、超大规模云服务商的投入加码、高性能计算与加速处理器需求攀升、高带宽内存(HBM)等先进存储技术的普及,以及现代云数据中心基础设施对高速、低延迟数据处理能力的迫切需求。

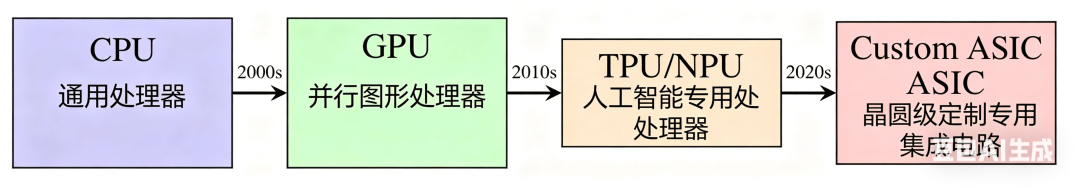

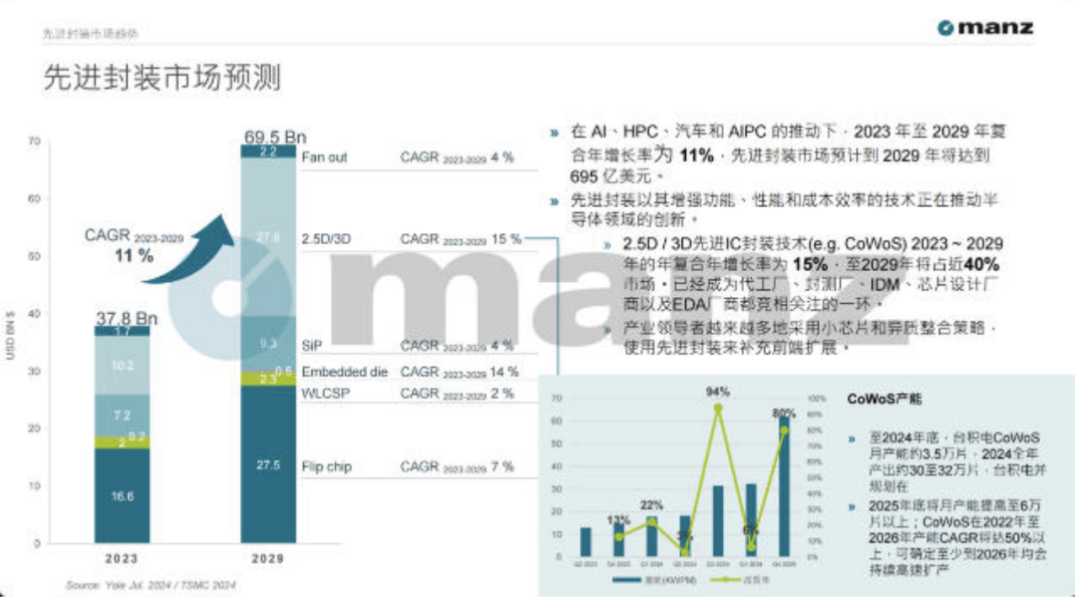

技术趋势方面,MarketsandMarkets在报告中指出,向定制化芯片与专用处理器设计的转型正在加速市场增长,云服务商旨在优化性能、成本与能效。通过开发针对特定工作负载的自研芯片,企业能够降低对第三方供应商的依赖,并提升系统级整体性能。基于小芯片(Chiplet)架构的创新进一步实现了可扩展、灵活的设计,支持在现代数据中心环境中高效集成计算、内存与互连组件。

# 数据中心半导体生态体系 #

数据中心生态系统是一套高度集成的架构,由多层半导体技术共同支撑起高性能计算与AI工作负载。其核心是AI处理器(包括英伟达、AMD、英特尔、谷歌、亚马逊云等厂商提供的GPU、CPU和ASIC),负责提供算力支撑。围绕核心算力层的是传感器组件(温度、气流、湿度传感器),用于保障运行效率;再向外是电源管理系统,包括亚德诺(Analog Devices)、英飞凌(Infineon)等厂商提供的控制器、转换器和电源管理芯片(PMIC)。连接层则由思科(Cisco)、Arista Networks等厂商的网卡(NIC)、交换机和互连器件组成,实现基础设施内的高速数据传输。此外,信号转换器、控制器等模拟器件为系统稳定性提供保障,让整个生态系统成为一个由计算、电源、传感与通信技术紧密耦合的协同网络。

图 数据中心半导体产品生态结构与主要参与厂商

根据MarketsandMarkets的预测,边缘处理器和GPU将在处理器领域占据更大的市场份额,而温度传感系统的增长速度可能是整个生态系统中最快的,模拟开关也会在数据中心应用中发挥日益重要的作用,下面是MarketsandMarkets针对这几个细分市场的预测。

边缘处理器/GPU细分市场预计将在2029年占据比现在更大的市场份额,核心驱动力是边缘侧AI推理的爆发式增长 —— 这类场景对实时数据处理有极高要求。自动驾驶系统、工业自动化、智能安防、边缘分析等应用均需要低延迟决策,而部署在数据源附近的高性能处理器与GPU是实现这一目标的最佳方案。与集中式云端处理不同,边缘环境需要高效、紧凑且功耗优化的计算方案,这推动了先进边缘处理器与GPU的广泛采用。此外,AI赋能设备的普及与5G网络的扩张正在加速边缘计算部署,进一步提升了本地化处理能力的需求。英伟达、英特尔、AMD等头部半导体企业持续在边缘AI硬件领域创新,不断提升能效比与可扩展性。随着企业越来越重视实时洞察、带宽优化与数据隐私,边缘处理器/GPU细分市场预计将在2029年主导市场格局。

温度传感系统预计将在2029年前成为平均增长速度最快的产品大类,核心驱动力是日益密集、高功耗数据中心环境中热监控与管理的关键需求。随着AI工作负载不断推高机柜功率密度,维持最佳运行温度对性能、可靠性和硬件寿命至关重要。温度传感系统被广泛部署在服务器、GPU、电源单元和冷却系统中,是数据中心应用最广泛的组件之一。英伟达、英特尔等企业推出的高性能处理器与加速器大幅提升了发热量,因此精准的实时热监控成为必需。温度传感器也是液冷、AI 驱动热优化系统等先进冷却技术的基础。随着数据中心持续扩张并优先保障能效与运行时间,温度传感器的需求预计将大幅增长,推动其在2029年占据重要的市场份额。具体到产品,MarketsandMarkets认为,随着数据中心越来越重视能效、可扩展性与业务连续性,48V热插拔控制器与eFuse的需求将大幅增长,预计将成为数据中心半导体市场中增速最快的细分领域。驱动因素来自现代数据中心持续向48V电源架构转型。随着AI工作负载使机柜功率密度不断提升,传统12V系统效率不足,推动行业采用48V配电方案以提高能效、降低损耗。热插拔与电子保险丝(eFuse)器件可实现不停机安全插拔、移除与保护高功率组件,对保障数据中心持续运行至关重要。这类方案提供过流、过压、热管理等高级保护功能,确保高密度环境下的系统可靠性。

此外,模拟开关类别预计在2029年也将拥有广泛的成长空间,原因是其在数据中心基础设施多层架构中应用广泛、不可或缺。模拟开关广泛用于信号路由、电源时序控制、电压调节与接口管理,覆盖服务器、存储系统与网络设备全场景,属于高用量通用器件。随着数据中心为支撑AI与高性能工作负载持续扩容,对高效信号完整性与系统控制的需求持续提升,带动模拟开关方案需求增长。同时,硬件架构复杂度不断提升(集成处理器、内存、互连),需要模拟开关提供灵活可靠的信号路径管理。凭借成本低、部署量大、保障系统平稳运行的关键作用,模拟开关在服务器的开关中将拥有更重要的作用。

# 数据中心建设热潮推高半导体需求 #

云服务提供商对数据中心的战略性投资,为AI半导体市场带来了重大机遇。其中,人工智能与机器学习工作负载的指数级增长,正推动对高性能半导体的需求,尤其是GPU、ASIC以及专用AI加速器。云计算、AI即服务(AIaaS)等基于云端的AI服务的普及,预计将在未来五年创造可观的增长机会。AI数据中心的持续建设将提升对并行计算的需求,进而成为市场的核心驱动力。深度学习与机器学习算法在数据中心应用中的大规模普及,推动了服务器专用AI半导体的需求,这类芯片可优化服务器性能,高效执行复杂的AI任务。

# 推动因素:AI专用硬件的持续迭代 #

AI专用硬件的持续进步是数据中心半导体市场增长的核心驱动力。企业正越来越多地开发专用处理器,以更高效地处理复杂AI工作负载。谷歌、亚马逊云(AWS)、Meta、微软、腾讯等头部云服务商,正大力投入定制化芯片研发(如 TPU、Trainium、Inferentia),为深度学习、神经网络训练等AI任务优化性能。这些专用加速器相比通用处理器,效率更高、延迟更低。Meta的MTIA加速器、微软Maia 100 AI芯片与Cobalt CPU、紫霄 / 沧海 / 玄灵系列芯片等创新成果,凸显了自研ASIC开发的行业趋势。这一趋势正通过优化工作负载、降低对第三方供应商的依赖、提升数据中心整体性能,持续强化AI服务器生态。

# 制约因素:高昂的初始投资成本 #

前期高额投入是数据中心半导体市场的关键制约因素。面向AI的基础设施所需资本与运营支出,远高于传统系统。尽管GPU已发展为AI与数据分析的强大加速器,但其先进能力(尤其是高端配置)溢价显著。成本负担不仅包括硬件采购,还涵盖部署、网络集成、系统管理、维护、人员培训、软件授权,以及高额的电力与冷却费用。AI服务器与传统服务器的核心成本差异来自GPU,其物料成本占比可超70%。因此,基于NVIDIA A100、H100等平台的AI服务器,价格可达标准服务器的15-32倍,限制了中小企业的采用。

# 机遇:云服务商的数据中心规划投资 #

云服务商对数据中心的规划性投资,为AI半导体市场创造了重大机遇。这类企业越来越依赖先进芯片支撑AI工作负载,通过在服务器中集成专用半导体,可提升处理性能、增强可扩展性,高效支撑各类AI应用。微软、谷歌、亚马逊云(AWS)等头部厂商正积极扩张全球数据中心布局,预示着高性能半导体解决方案未来需求强劲。

例如,微软宣布投资5亿美元扩建魁北克的云与AI基础设施;谷歌推进乌拉圭Teros数据中心项目;AWS计划在沙特阿拉伯投资超53亿美元新建数据中心。这些大规模投资预计将加速AI半导体的普及,推动市场持续增长。

# 挑战:供应链中断 #

供应链中断对数据中心半导体市场构成重大挑战,尤其影响AI服务器基础设施的及时部署。GPU交付延迟会给希望扩展AI能力的企业带来关键瓶颈,因为这类处理器是训练与推理工作负载的核心。延迟通常由组件短缺、产能限制与需求激增导致,对硬件制造商、系统集成商、云服务商及终端用户产生连锁影响。高性能GPU(如NVIDIA H100、A100)的供需失衡尤为突出,其服务器交付周期可长达52周。漫长的交付周期会拖慢基础设施扩张、推高成本,并阻碍AI服务器与数据中心半导体市场的整体增长势头。

评论区

登录后即可参与讨论

立即登录