800V进入AI数据中心,不是换一个电压数字这么简单。机柜功率上来以后,电怎么安全进柜,怎么一路降到GPU附近,发热和故障怎么处理,都会变成实际设计问题。

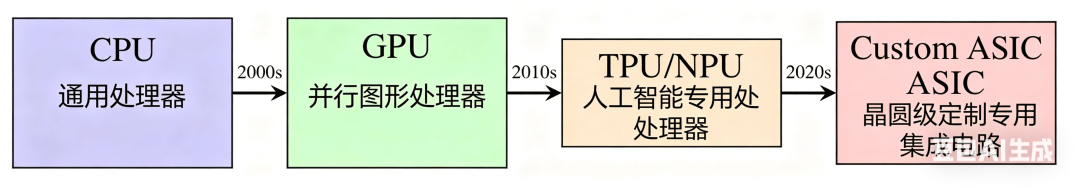

AI数据中心最容易被看到的,还是GPU。

但一台台AI服务器装进机柜后,单个机柜里的GPU、加速卡和电源模块越来越多,整柜耗电增加。线缆、连接器、母线、电源模块和散热系统很快会先感受到压力。

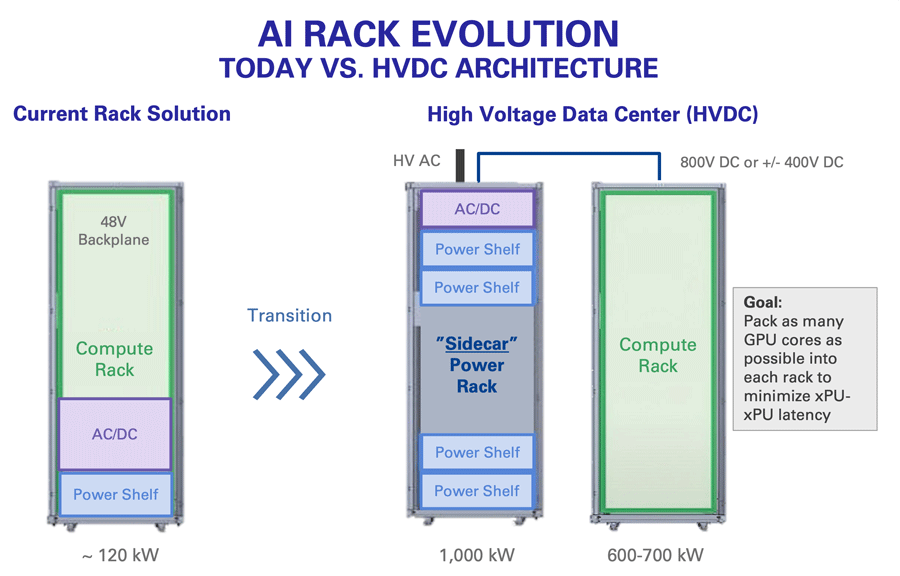

单柜耗电增加,低压大电流开始吃力

功率固定时,电压越低,电流越大。AI服务器越堆越密,供电路径上的电流就越难处理。电流增加后,线缆和连接器要承受更高负载,母线和电源模块的损耗会上升,发热也更难压住。

机柜里的空间有限,线缆不能无限加粗,连接器不能无限加大,散热也不能一直靠堆风扇和散热器解决。继续沿用低压大电流方案,工程代价会越来越高。

提高机柜侧供电电压,可以在同等功率下降低电流。电流降下来,线缆、连接器、铜排和电源模块上的损耗会减轻,布线和散热压力也会下降。电压升高以后,高压隔离、热插拔、故障保护和监测电路也要重新设计。

800V进入机柜后,还要一路降到GPU核心附近

AI数据中心讨论800V,不能只看机柜入口。高压电进入机柜后,还要经过中间母线、电源模块和板级电源,最后送到GPU、CPU和加速器附近。

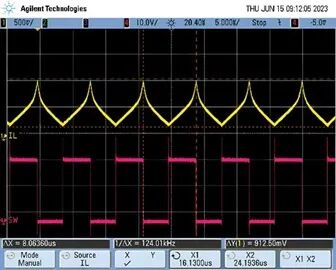

越靠近负载,电压越低,电流越大。GPU负载变化快,电源要在很短时间内跟上电流变化。响应跟不上,电压波动、发热和效率都会受影响。

这一路上,每一段都有不同问题。机柜入口要处理高压连接、热插拔和输入保护;中间母线要完成隔离和降压;板级电源要靠近GPU和加速器,提供低压大电流;遥测和保护电路要持续监测电压、电流、温度和故障状态。

这些部件平时没有GPU显眼,但任何一段处理不好,都会影响整柜效率、维护难度和长期可靠性。

TI给出的两级转换路径

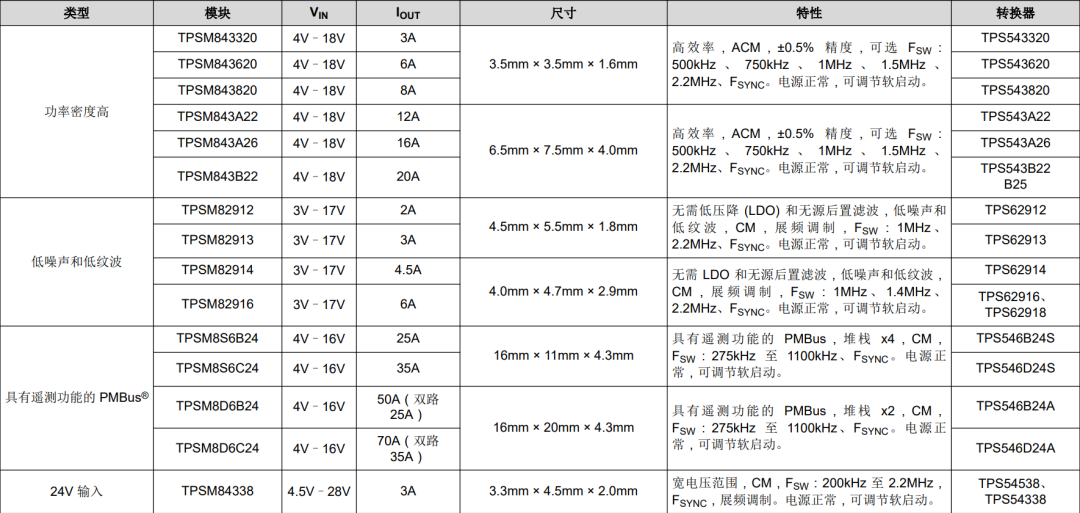

TI给出的800V DC电源架构,核心是一条两级转换路径。高压电进入机柜后,先通过800V到6V的隔离母线转换,再由6V到低于1V的多相Buck给GPU核心供电。TI官方资料称,这种架构从800V到GPU核心供电只需要两级转换。

在这套路径里,800V热插拔控制器负责800V电源轨的输入侧保护;800V到6V DC/DC母线转换器用于计算托盘的高密度降压;6V到低于1V的多相Buck转换器负责给先进GPU核心提供大电流。

这条路径对AI服务器意味着什么

机柜侧电压抬高后,电流压力会先降下来,线缆、连接器和母线上的损耗会减轻。但电压提高以后,隔离、热插拔、母线转换、板级大电流供电、遥测和保护都要重新匹配。任何一级效率不够,都会带来发热、体积和供电稳定性问题。

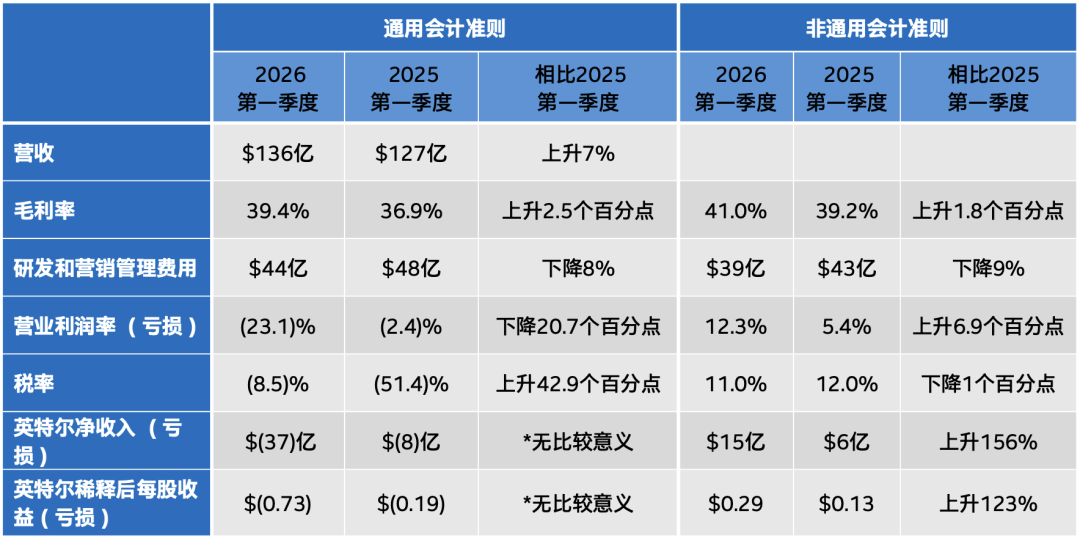

过去谈AI数据中心,市场最先想到的是GPU和算力平台。现在单柜耗电增加,电怎么从机柜入口送到GPU核心附近,也开始进入基础设施设计的核心问题里。放到AI数据中心里,从高压输入、隔离转换,到板级大电流供电、保护和监测,正是模拟和嵌入式器件会发挥作用的地方。

当AI数据中心不只讨论GPU,也开始讨论电源架构、热插拔、隔离、遥测和板级供电时,这类器件和方案的重要性就会被放大。

800V进机柜后,功率器件、保护和驱动都要跟上

TI的两级转换路径,把机柜输入、中间母线和板级大电流供电串了起来。电压从800V一路降到GPU核心附近,后面就不只是电源架构的问题,功率器件、保护、监测和驱动也都要跟上。

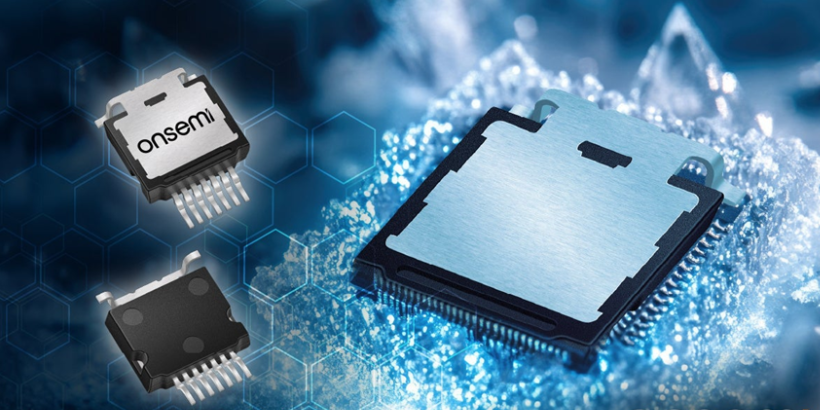

高功率转换和功率器件这一段,onsemi已有相关布局。onsemi公开资料显示,公司正与NVIDIA合作,支持下一代AI数据中心向800VDC电源架构过渡;其智能功率产品覆盖高压AC/DC转换、固态变压器、电源供应单元、800VDC分配和处理器级供电,并涉及硅、SiC和GaN等功率器件。

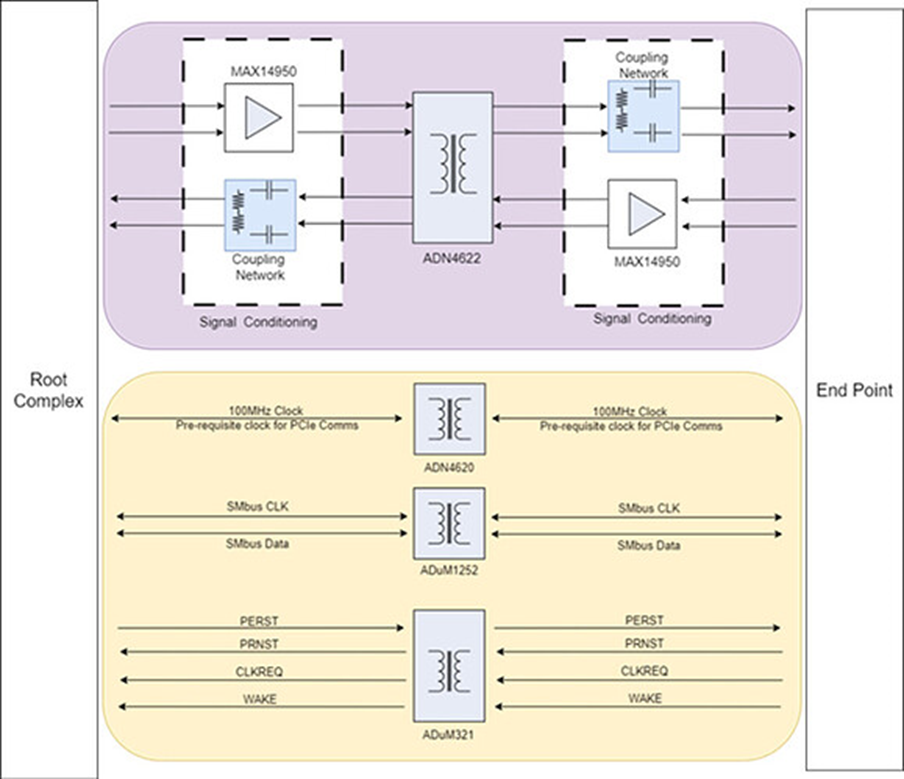

高压热插拔、保护和遥测这一段,ADI给出了更具体的应用说明。ADI关于AI服务器800V热插拔的资料提到,GPU功耗增加和单机柜计算密度提高,正在推动机柜级供电从48V向800V演进。电压提高后,服务器托盘带电插拔时的浪涌电流、高压保护、故障记录,以及电压、电流、功率和温度监测,都要重新处理。

在电流检测和功率器件驱动上,Allegro的相关产品主要面向数据中心PSU中的电流传感器和栅极驱动IC,用于提升效率、功率输送、故障检测和热管理。它的隔离栅极驱动资料也指向GaN、SiC等功率器件驱动。高压和高频开关环境里,电流反馈要足够快、足够准,驱动也要足够稳定,控制、保护和热管理才能跟得上。

放到整柜设计里,这些器件对应的都是很具体的工作:高压输入要安全接入,电压要高效转换,GPU核心要获得稳定的大电流,电流和温度要被持续监测,故障要及时保护,功率器件要被稳定驱动,热也要及时带走。

GPU仍然是最显眼的器件,但AI服务器能不能做得更密、更省电、更稳定,会越来越依赖这些电源、功率器件、监测、保护和驱动设计。

算力继续增加,供电会越来越关键

GPU还会继续是AI数据中心里最受关注的器件。

但单柜耗电继续增加后,电源架构会越来越影响系统设计。高压电怎样进入机柜,中间母线怎样降压,板级电源怎样贴近GPU和加速器,热插拔和保护怎样保证安全,遥测怎样帮助系统发现异常,这些都会进入客户评估。

后面拉开差距的,不会只是一两个器件参数。机柜能不能做得更密,电源转换效率能不能提高,发热能不能压住,故障能不能快速定位和隔离,电源模块能不能安全维护,都会影响AI集群的建设和运维成本。

800V进入AI数据中心,说明AI基础设施的竞争已经延伸到电源、功率器件、隔离、驱动、传感、保护和监测这些环节。算力继续增加以后,电能不能稳定、可靠、高效地送到处理器附近,会影响AI集群的规模、效率和运维成本。

评论区

登录后即可参与讨论

立即登录