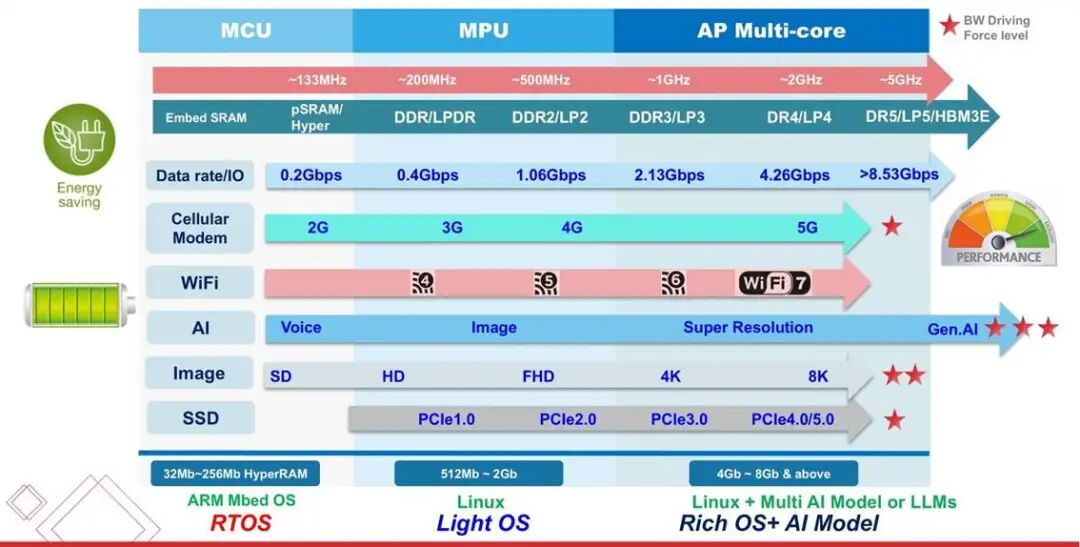

内存市场今年面临严峻挑战。由于制造商优先为数据中心和大规模AI工作负载供应DDR5和高带宽内存(HBM),内存供应趋紧,成本大幅飙升:与2025年第三季度相比,价格已上涨了3至4倍,且市场信号表明价格峰值尚未到来。

据报道,即便是通常处于市场优先级的超大规模云厂商,也仅获得了约70%的分配容量。分析师预计,这种紧张局面将贯穿2026年全年,甚至可能延续至2027年。

这种压力并非均匀分布。价格涨幅最大、交货周期最长的内存模块集中在高容量领域。这些器件直接处于云基础设施需求的核心路径上,其价格也反映了这一点。反之,低容量模块(1至2GB)仍然供应充足且价格稳定。

这一趋势正在改变团队对系统设计的思考方式。那些围绕大内存需求构建的AI工作负载如今正面临采购挑战;而设计用于在适度内存环境下运行的系统,既能规避价格飙升,又能躲过供应不确定性。其结果至关重要:在内存短缺背景下,为提高效率而构建的架构,相比为充足内存而设计的架构,能赋予团队更大的战略自由度。

最有效的解决方案:无DRAM AI加速器

在内存市场资源紧张的情况下,最鲁棒的解决方案往往也是最简单的:完全消除对外部DRAM的依赖。以Hailo-8和Hailo-8L AI加速器为例,它们通过将完整的推理流水线集成在芯片上,省去了系统中成本最高且供应最紧张的元器件。

实际上,避免使用DRAM可将每个设备的物料成本降低高达100美元,同时还能提高能效、降低延迟并增强系统可靠性。然而,并非所有AI应用都能完全摆脱DRAM。

生成式AI工作负载本身就需要更多内存,运行这些工作负载的系统仍需依赖外部DRAM。但即便如此,内存限制也强烈促使我们将推理过程部署到更靠近边缘的位置。

在边缘侧运行生成式AI,让团队能够使用更小、更特定领域的模型,而非为云端设计的大型通用模型。更小的模型意味着更少的DRAM需求,从而降低成本、简化采购流程并提高能效。边缘加速器正是在此发挥作用,它能够实现高效的生成式AI推理,同时尽可能减少内存占用。

隐私和延迟问题长期以来一直是推动在设备端运行AI的关键因素。2025年,另一个因素进一步巩固了这一趋势:用户期望生成式AI能够即刻可用。如今,用户依赖转录、摘要、音频清理、翻译和基本推理等功能,往往无法容忍启动延迟或对网络的依赖。

亚马逊云科技 (AWS)、微软Azure和Cloudflare近期发生的云服务中断事件,凸显了“纯云”假设的脆弱性。当网络出现中断时,消费者应用和企业工作流程中的日常功能都会失效。即使是短暂的中断也表明,单一的基础设施依赖性就可能导致用户每天使用数十次的工具瘫痪。

随着AI更深入地融入日常工作流程,用户期望能够即时使用智能AI功能,混合方案被证明更具韧性。将常用的AI功能保留在本地(如设备端或附近的网关),而将更繁重或不常用的任务部署到云端。至关重要的是,当模型足够小,可以在1至2GB内存内运行时,利用仍然很容易获得的内存配置,这种混合方法就更容易实现。

小模型改变了游戏规则

直到最近,生成式AI还依赖于云端的内存和计算规模。如今,新型小型语言模型(SLM)和紧凑型视觉语言模型(VLM)能够以极少的参数实现强大的指令跟踪能力、可靠的工具使用以及极具竞争力的基准测试性能。

IBM Granite 4.0 Nano系列等产品的发布,充分展现了高效架构的进步。这些模型表明,某些生成式AI任务和应用不再需要海量且昂贵的系统内存,它们只需要定义明确的领域、优化的推理路径以及高效的预处理和后处理。

对于硬件团队而言,这种演进带来了诸多实际好处。更小的模型降低了多年来AI设计中固有的“内存税”。当整个智能流水线仅需1至2GB的DRAM即可运行时,多项限制因素将同时放宽:

成本降低:系统无需承担高容量DRAM的高昂价格。

供应链风险降低:低容量内存芯片更容易采购。

功耗降低:由于采用硬件辅助卸载(NPU或AI加速器)的小型模型运行温度更低、效率更高。

可靠性提高:即使在网络中断期间,本地推理也能确保关键功能保持在线。

这种以效率而非规模为导向的AI架构与边缘计算的理念完美契合。许多高价值的智能体AI任务——例如总结对话、描述图像或翻译语音——并不需要庞大的模型。在特定领域,由于未知因素更少,紧凑型模型可以提供更快、更私密、更一致的结果。

未来之路

DRAM短缺证明了一件事:最具韧性的AI系统是那些围绕限制而非过度设计的系统。团队正在重新评估关于模型规模、内存基线以及常见任务“足够好”的标准等假设。他们意识到,特定领域的智能通常比蛮力扩展表现更佳——尤其是在需要一致性、隐私性和低功耗的环境中。

边缘AI自然而然地契合了这一需求。它的内存配置与仍然可用的DRAM容量相匹配,其部署模式为用户最依赖的任务带来了稳定性。随着供应紧张的持续,投资于更精简的模型设计和混合部署策略的组织,将更有能力提供稳定、响应迅速的AI,而无需承担高昂的内存成本。

评论区

登录后即可参与讨论

立即登录